通往AGI之路:三巨头的路线之争与统一视角

本文梳理了Yann LeCun、Richard Sutton和Ilya Sutskever三位AI专家对实现通用人工智能的不同核心理念,探讨了其各自的技术路径与潜在的融合可能。

在通往通用人工智能的道路上,不同的技术路线图引发了深刻的思考。Yann LeCun、Richard Sutton 和 Ilya Sutskever 三位人工智能领域的代表人物,分别提出了构建 AGI 的核心理念,这些理念代表了当前研究中对智能本质的不同理解与实现路径。

核心内容

Yann LeCun 强调感知与世界模型的重要性。他认为,AGI 需要强大的视觉等感知能力来构建对世界的理解模型。其提出的 JEPA 架构,核心在于通过预测世界状态的内在表征来学习,将理解世界视为智能的基础。

Richard Sutton 则坚信智能源于与环境的持续互动。他提出的 OaK 框架旨在构建一个持续学习、终身学习的智能体,其关键在于一个实时的“行动-反馈-奖励”循环。智能诞生于这一动态过程之中。

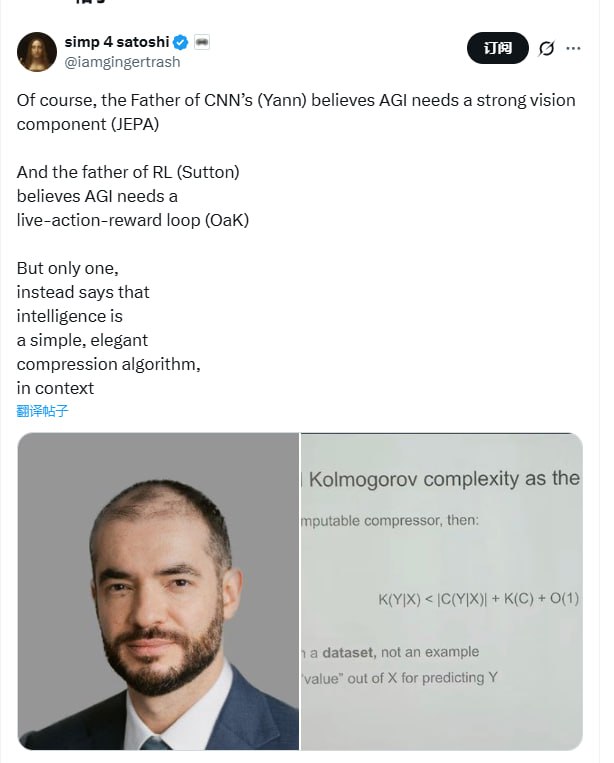

Ilya Sutskever 提出了一个更为本质的观点:压缩即智能。他认为,智能的核心是一种在特定上下文中进行的高效、有条件的压缩算法。例如,预测下一个词或 token 的能力,本质上就是对世界信息进行极致压缩的表现。

针对这些观点,存在深度的解析与讨论。有观点认为,Transformer 架构本身及其在上下文窗口中进行上下文学习的能力,可以视为一种对信息的条件压缩,模拟了推理和学习过程。

许多评论者指出,这三条路径并非完全对立,而是从不同层面解读智能。从统一视角看,LeCun 的感知和 Sutton 的互动,都可以被视为为 Sutskever 的“压缩”提供数据和上下文。智能体通过感知世界并在互动中获得反馈,最终目标都是为了更精准地预测和建模世界,即进行更高效的“压缩”。从神经科学视角看,人脑中存在类似 CNN 的视觉皮层和类似 RL 的奖励通路,而“压缩”被认为是贯穿大脑的根本组织原则之一。

同时,这些理念也存在争议与局限性。例如,当前模型在信息压缩的效率和所学“电路”上仍有提升空间,JEPA 和 OaK 的思路正是为了解决这些问题。此外,对于“智能即压缩”这一概念本身,也存在定义和深度上的不同理解与争论。

价值与影响

这场关于 AGI 路径的辩论并非简单的三选一。Ilya Sutskever 的“压缩论”提供了一个深刻的顶层抽象视角,解释了无监督学习和 Transformer 架构的强大潜力。而 Yann LeCun 和 Richard Sutton 则更关注实现这种高效压缩所必需的具体机制,即如何感知世界以及如何与之互动。

综合来看,真正的 AGI 可能是这三条路径的最终融合:一个以压缩为核心原则,通过丰富的感知和持续的互动反馈,不断优化其世界模型的智能体。这场讨论有助于厘清不同技术路径的关系,为未来 AGI 的研究与发展提供了多维度的思考框架。