一份全面的 LLM 白皮书:从基础原理到前沿架构

谷歌高级总监发布了一份 171 页的 LLM 白皮书,系统性地介绍了从 Transformer 基础到前沿模型架构、推理对齐及代码实现等核心内容。

近日,曾发布经典 AI Agent 指南的谷歌高级总监再次发布了一份长达 171 页的 LLM 白皮书。这份文档旨在提供一份全面且系统化的学习资料,覆盖了大型语言模型领域的几乎所有关键节点,从核心原理延伸至前沿架构,为从业者和学习者绘制了一幅清晰的技术全景图。

核心内容

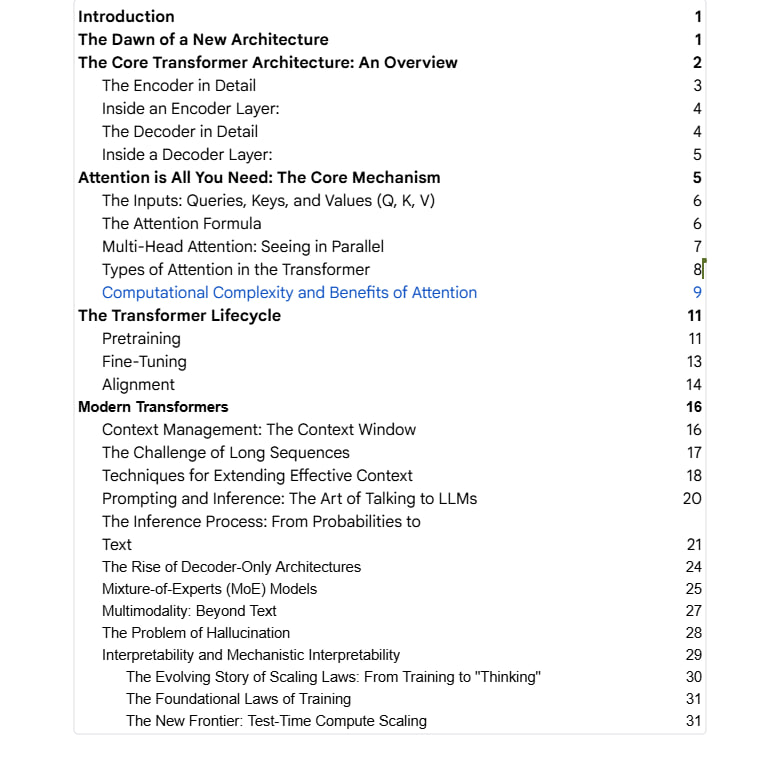

该白皮书内容详实,结构清晰,主要分为六个部分。

Part 1: 基础原理 从 Transformer 的开山之作《Attention is All You Need》讲起,深入浅出地剖析了 Encoder/Decoder、多头注意力机制、Scaling Laws 等基础概念,并延伸至上下文窗口管理、MoE(混合专家模型)、多模态等现代架构的核心思想。

Part 2: 推理与对齐 系统梳理了从思维链到思维树的高级推理范式演进,并详细拆解了 RLHF(人类反馈强化学习)、RLAIF、DPO 等关键的对齐技术,解释了模型如何学会“思考”并与人类价值观对齐。

Part 3 & 4: 核心技术与代码实现 不仅逐行拆解了基础 Transformer 的代码实现,还对 MoE、GQA(分组查询注意力)、RoPE(旋转位置编码)、KV Caching 等现代 LLM 赖以成功的关键优化技术,进行了原理与代码的双重解读。

Part 5 & 6: 前沿架构与源码剖析 全面评述了 2025 年各大厂商的旗舰模型架构,包括 DeepSeek-V3、Llama 4、Gemma 3、Qwen3 等,并以 Google 开源的 Gemma 3 为例,进行了源码级的深度剖析。

价值与影响

这份白皮书的价值在于其系统性和深度。它不仅仅是一个知识点的集合,更是一份由资深从业者精心整理的技术地图,将分散在不同论文、博客和代码库中的知识串联起来。对于希望深入理解 LLM 技术栈,从理论到实践,从历史发展到最新前沿的工程师和研究者而言,这份文档提供了一个高效的学习路径和宝贵的参考资料。