2024-2026年开源大模型架构图谱:收敛与分裂

本文基于 Sebastian Raschka 整理的 40 多个开源大模型架构图谱,分析了 2024 年至 2026 年间 LLM 架构的演进趋势。核心观察是设计语言趋同,但具体技术方案呈现分裂与混搭,反映出行业正...

TechFoco

共 7 篇文章,按时间倒序展示。

本文基于 Sebastian Raschka 整理的 40 多个开源大模型架构图谱,分析了 2024 年至 2026 年间 LLM 架构的演进趋势。核心观察是设计语言趋同,但具体技术方案呈现分裂与混搭,反映出行业正...

Google Research 研究发现,在不启用推理模式时,将提示词原样重复一遍可显著提升大语言模型在多项基准测试中的表现,且几乎不增加计算成本。

微软开源了 TRELLIS.2 模型,这是一个基于单张图片生成带纹理与 PBR 材质的 3D 模型的工具。它采用 4B 参数的 Transformer 架构和 O-Voxel 稀疏体素表示,支持高分辨率快速生成。

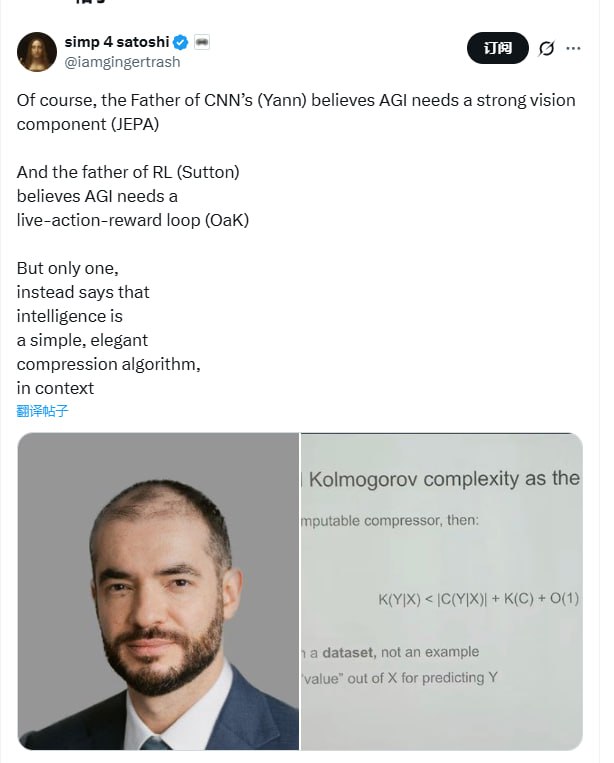

本文梳理了Yann LeCun、Richard Sutton和Ilya Sutskever三位AI专家对实现通用人工智能的不同核心理念,探讨了其各自的技术路径与潜在的融合可能。

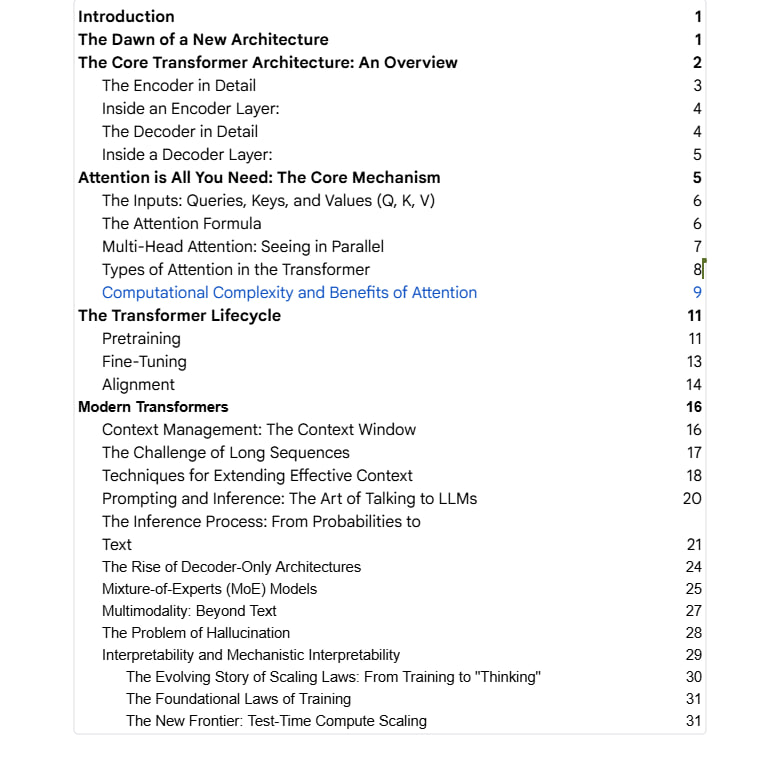

谷歌高级总监发布了一份 171 页的 LLM 白皮书,系统性地介绍了从 Transformer 基础到前沿模型架构、推理对齐及代码实现等核心内容。