Karpathy nanochat:8000行Rust代码实现LLM全流程

Karpathy开源项目nanochat,以不到8000行Rust代码完整实现了大语言模型从分词器训练、预训练、多任务微调、强化学习到轻量推理的全流程,并提供了CLI与Web界面。

近日,知名AI研究员 Andrej Karpathy 在 GitHub 上开源了新项目 nanochat。该项目以其极简的实现方式引人注目,仅用不到 8000 行 Rust 代码,便完整覆盖了大语言模型从训练到推理的全流程。这为希望深入理解 LLM 内部工作机制的开发者和研究者提供了一个清晰、高效的参考实现。

核心内容

nanochat 项目的核心在于其端到端的实现路径。它首先使用 Rust 实现了高效的 tokenizer 训练模块。随后,项目在 FineWeb 语料上对 Transformer 架构的 LLM 进行预训练,并设计了多维度的评估指标来监控训练过程。

在模型优化阶段,项目支持监督微调,并在 ARC-E/C、MMLU、GSM8K、HumanEval 等涵盖世界知识、数学和代码能力的基准测试中取得了优异表现。为进一步提升特定能力,例如解答数学题,项目还集成了名为“GRPO”的强化学习算法进行微调。

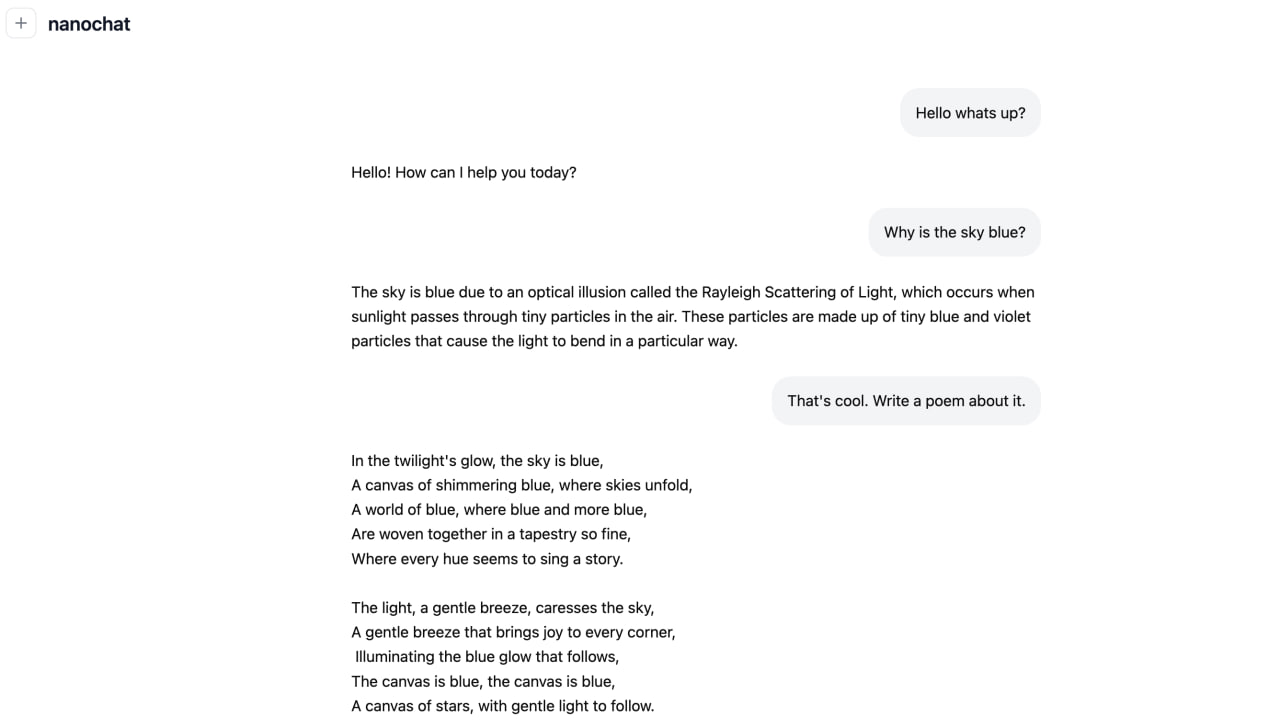

在推理部署方面,nanochat 提供了一个轻量化的推理引擎,支持 KV 缓存、简单的预填充与解码策略,并集成了 Python 沙箱以支持工具调用功能。项目同时提供了命令行界面和类似 ChatGPT 的网页 UI,方便用户交互。此外,系统能够生成统一的 Markdown 格式评估报告,便于结果总结与对比。

在模型架构设计上,nanochat 采用了类似 LLaMA 的稠密 Transformer 结构,具体技术选型包括 rotary 位置编码、QK 归一化、未绑定的嵌入/反嵌入层、ReLU² 激活函数的 MLP 以及无偏置的线性层,整体设计追求简洁与高效。训练优化器结合了 Muon 与 AdamW,推理过程中则应用了 logit softcap 技巧以提升稳定性。

价值与影响

nanochat 项目的价值在于其极简的代码展示了训练大语言模型的核心全貌,突破了传统大型深度学习框架的复杂性壁垒。使用 Rust 语言进行实现,不仅体现了对性能与内存安全的追求,也预示着 LLM 开发工具链可能向更轻量级、模块化的方向发展。

项目中对多任务训练、监督微调与强化学习的结合实践,为 LLM 在实用场景中的持续迭代与能力专项提升提供了可行的技术路径。对于广大开发者和研究人员而言,这样一个高质量的开源实现极大地降低了从零开始理解、构建和调优大语言模型的门槛,有望催生更多定制化、轻量级的智能应用创新。