现代采样器入门指南:平衡 LLM 文本生成的创造力与连贯性

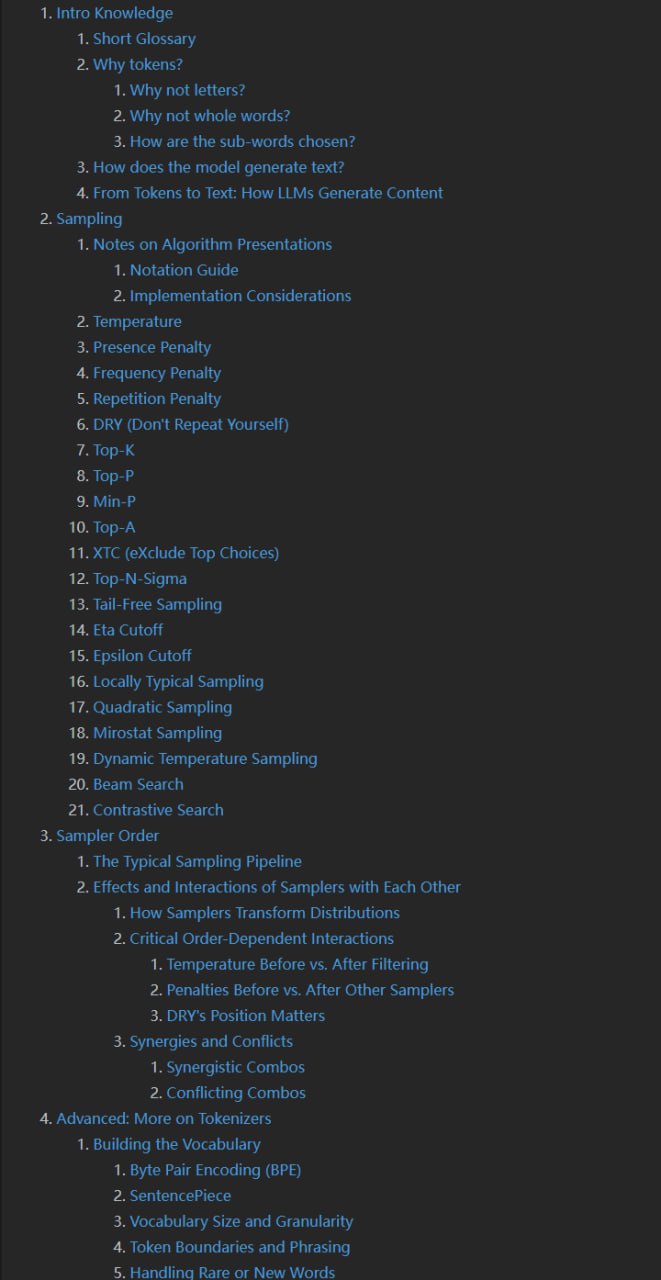

本文系统介绍了大语言模型文本生成中的核心采样技术,涵盖多种采样方法、词元化器设计及其交互影响,旨在阐明如何通过合理组合采样策略来优化生成文本的质量。

大语言模型(LLM)的文本生成能力已广泛应用于对话、创作和代码生成等多个场景。其生成过程并非简单的“预测下一个词”,而是基于复杂的概率分布进行采样。采样技术的选择与组合,直接决定了生成文本在创造力、连贯性和多样性之间的平衡,是构建可控、高质量文本生成系统的关键。

核心内容

采样过程始于模型输出的词元(token)概率分布。基础方法是贪婪采样,即始终选择概率最高的词元,但这容易导致输出单调重复。因此,引入可控的随机性成为提升多样性的核心。

词元分解是采样策略的基础。现代模型普遍采用子词(subword)级别的词元化,例如通过 BPE 或 SentencePiece 算法实现。这种方法有效解决了词汇表过大、未知词处理以及字符级序列过长的问题,增强了模型的泛化与跨语言能力。

采样技术种类多样,各有侧重:

- 温度调节:通过缩放 logits 来调整概率分布的平滑度,控制输出的“创造力”或随机性。

- Top-K 与 Top-P:限制候选词元的数量或累积概率,以聚焦于高概率选项。

- DRY:通过检测重复的 n-gram 模式并施加惩罚,防止模型重复自身。

- Mirostat:一种自适应采样方法,旨在动态调整采样过程以维持目标惊讶度(perplexity)。

- 其他技术还包括频率惩罚、尾部自由采样、集束搜索和对比搜索等。

采样技术的执行顺序对最终结果有显著影响。例如,先进行温度调节再进行 Top-K 过滤,会放大候选词之间的概率差异;而先过滤再调节温度,则会对选项施加更严格的限制。惩罚机制的放置位置同样会影响抑制重复的效果。

不同采样器之间存在交互效应。部分组合可以协同增效,例如 Top-K 与 Top-P 常结合使用以稳定输出。而某些组合可能相互冲突,例如高温度设置配合过低的 Top-K 值,可能会过度限制多样性。

价值与影响

深入理解采样技术的本质与细节,对于构建更智能、更可控的文本生成系统至关重要。合理的采样策略不仅能提升即时生成文本的质量,更影响着模型在多样性、上下文理解和长程连贯性之间的根本权衡。这直接决定了模型在不同应用场景(如创意写作、技术对话或结构化代码生成)中的适用性与最终效果。掌握这些技术,有助于推动大语言模型向更实用、更具创新性的方向发展。