现代大语言模型采样入门指南

TechFoco 精选

本文系统介绍了大语言模型文本生成中的采样技术,从分词基础到温度调节、Top-K、Top-P等核心策略,并探讨了参数协同对生成质量的影响。

文本生成是大语言模型(LLM)的核心能力之一。模型在预测下一个词元(token)时,并非总是选择概率最高的选项,而是通过一系列采样策略来引入随机性和多样性,从而生成更自然、更具创造性的文本。理解这些采样技术的工作原理,是有效配置和使用大语言模型的关键。

核心内容

文章首先从基础的分词(Tokenization)原理讲起,解释了为何现代 LLM 普遍采用子词(Subword)分词方法,如字节对编码(BPE)和 SentencePiece。这些方法在词汇量、处理未知词和模型效率之间取得了平衡,是文本生成的前置步骤。

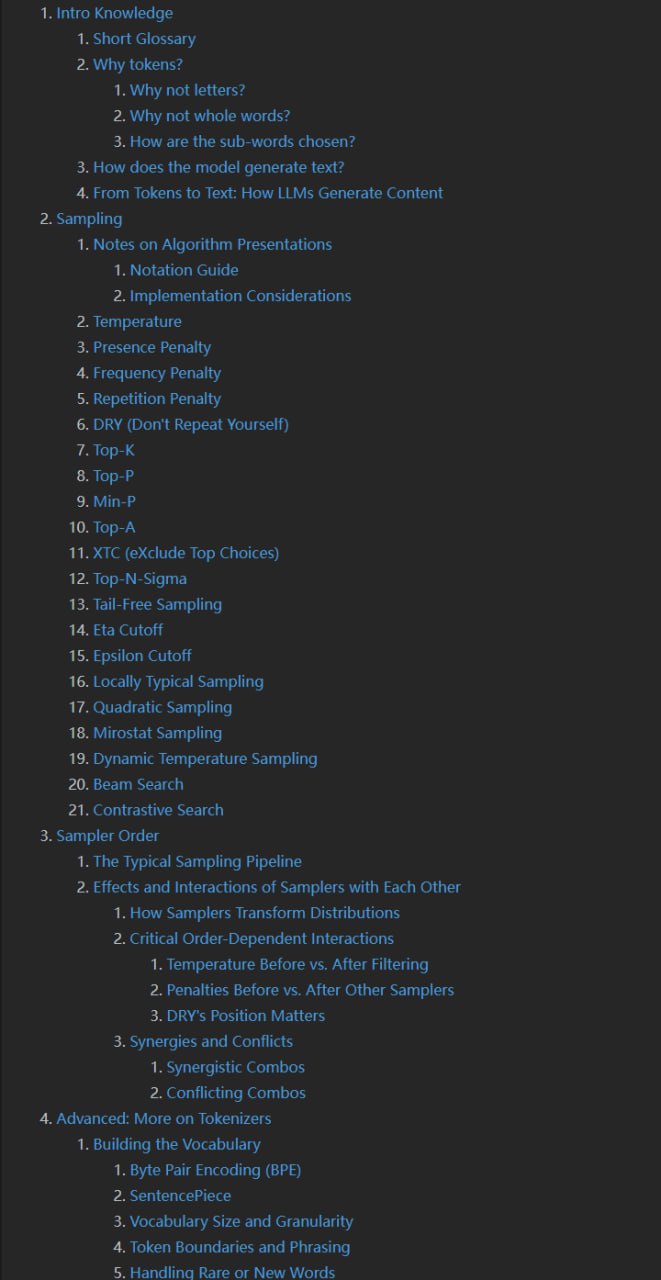

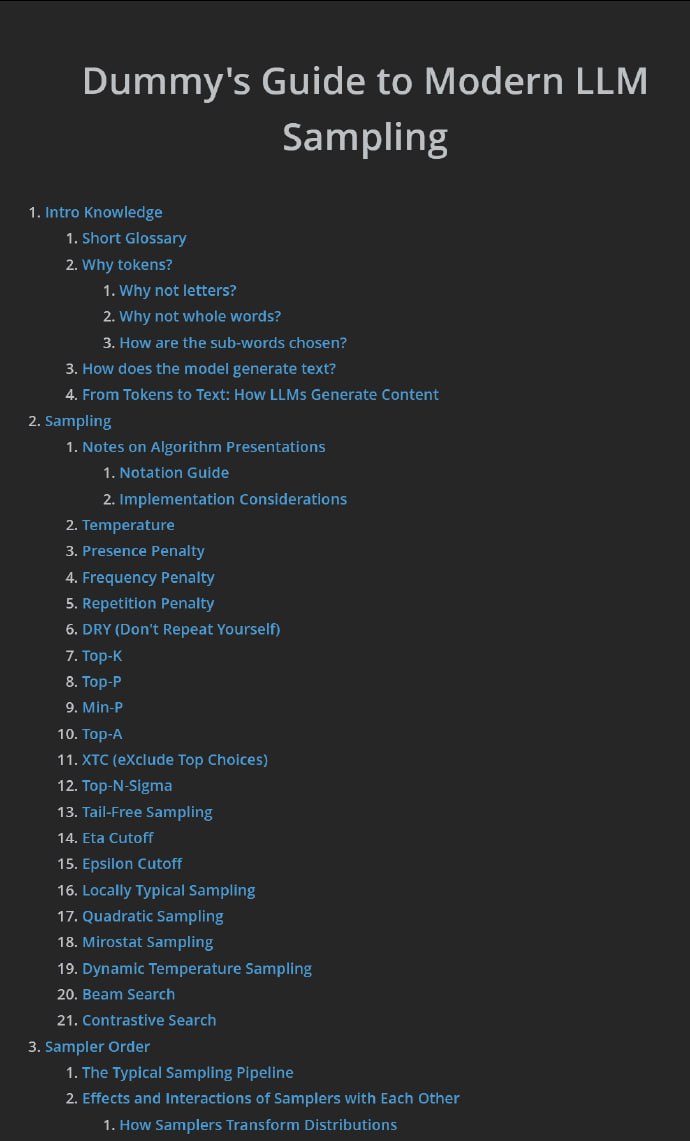

随后,文章详细解析了多种核心采样策略:

- 温度调节(Temperature Scaling):通过调整 softmax 分布的平滑程度来控制输出的随机性。高温增加多样性,低温使输出更确定、更集中。

- Top-K 采样:仅从概率最高的 K 个候选词元中进行采样,排除低概率的长尾词元。

- Top-P(核采样):从累积概率超过阈值 P 的最小候选词元集合中采样,能动态适应不同分布的预测。

- 重复惩罚(Repetition Penalty):对已出现过的词元进行概率惩罚,有效减少生成文本中的不必要重复。

文章进一步探讨了这些方法并非孤立使用,它们之间存在相互作用与组合效果。例如,通常先应用温度调节来重塑概率分布,再执行 Top-P 或 Top-K 采样。采样顺序和参数(如温度值与 Top-P 阈值)的协同设置至关重要,不当的组合可能导致生成质量下降。

价值与影响

系统掌握这些采样技术,使开发者能够更精细地控制大语言模型的生成行为。通过合理配置采样策略,可以在文本的质量(准确性与合理性)、多样性(创意与丰富度)和连贯性(逻辑与流畅度)之间找到最佳平衡点。这不仅是提升对话系统、内容创作等应用效果的基础,也是深入理解模型生成机制、进行有效调试和优化的必经之路。