Nanonets-OCR2:开源图像转Markdown模型解析

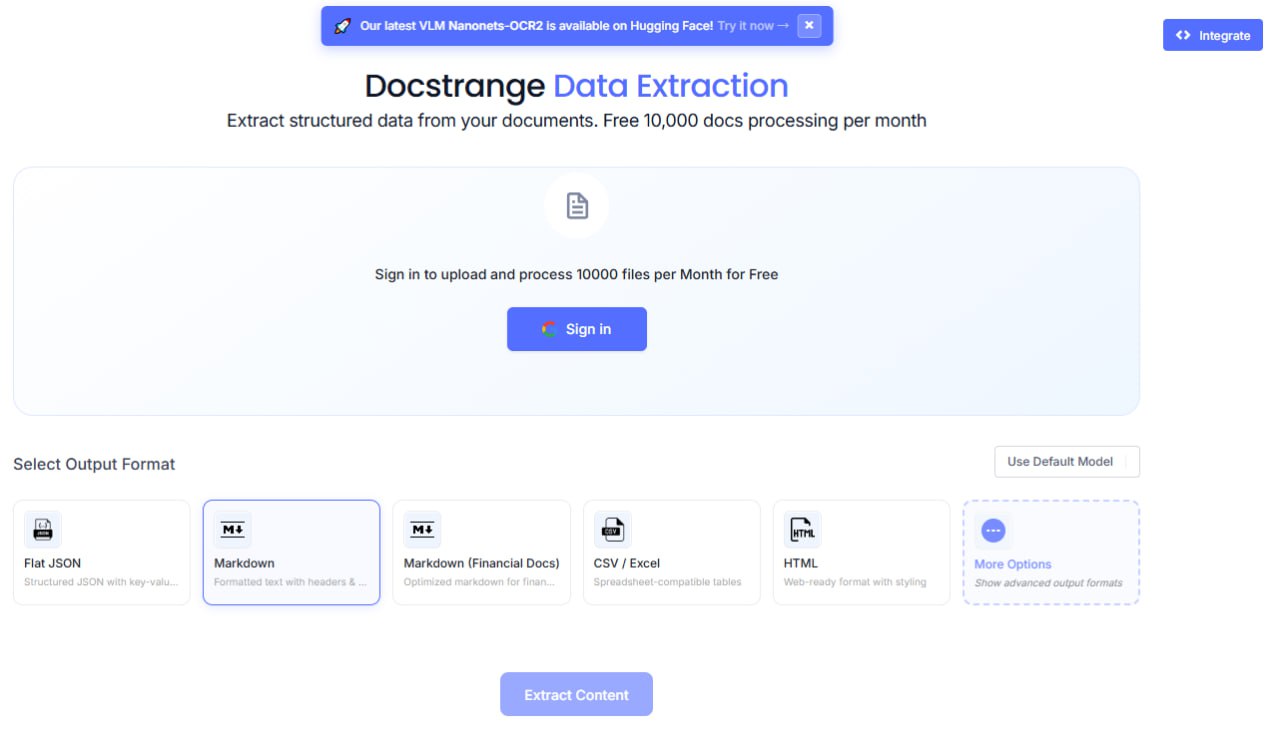

Nanonets-OCR2是一款开源模型,可将图像文档智能转换为结构化的Markdown格式。它不仅能提取文本,还能精准识别LaTeX公式、复杂表格、图表、签名水印等多种元素,并支持多语言、手写文档及视觉问答功能。

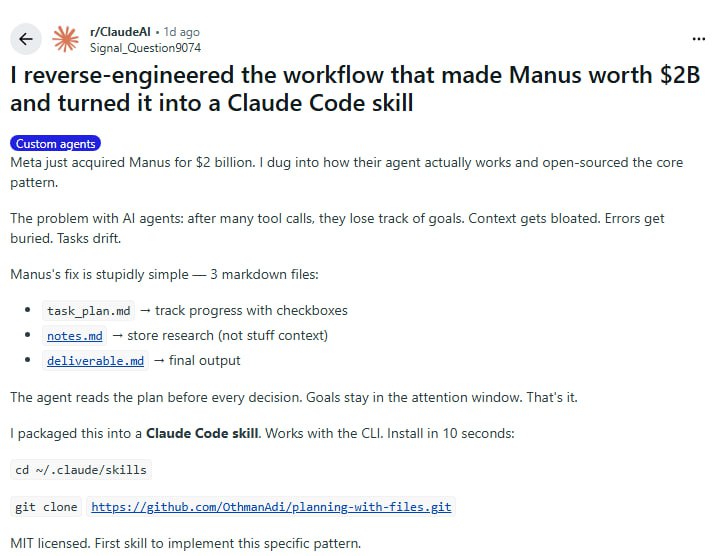

在文档数字化与信息处理领域,传统的OCR技术主要聚焦于文本提取,难以理解文档的复杂结构与语义信息。随着大语言模型和多模态AI的发展,将图像文档转换为结构化、机器可读的格式变得愈发重要。Nanonets-OCR2应运而生,它是一款开源的图像转Markdown模型,旨在超越传统OCR,实现对文档内容的智能理解与结构化输出。

核心内容

Nanonets-OCR2的核心能力在于其深度内容识别与结构化转换。模型不仅能提取文本,更能理解文档的语义和视觉元素,并将其精准映射为Markdown等结构化格式。

其核心功能包括:

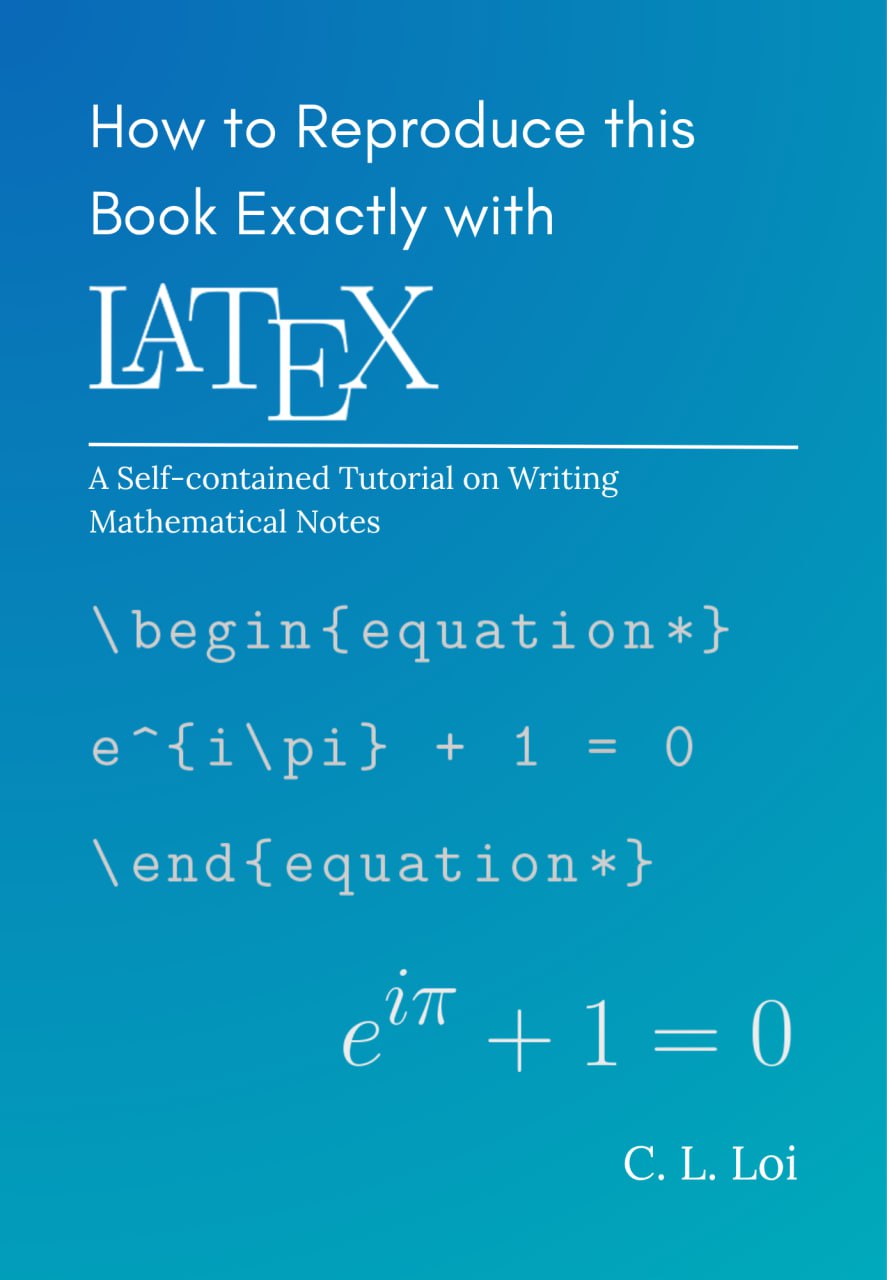

- LaTeX公式识别:自动区分行内公式与块状公式,并准确转换为LaTeX格式。

- 智能图片描述:为文档中的图片(如logo、图表、流程图)生成结构化描述。

- 签名与水印提取:准确识别签名和水印,并用专属标签隔离,便于法律与商务文件处理。

- 表单控件处理:将复选框、单选按钮标准化为Unicode符号(☐、☑️、☒),实现统一解析。

- 复杂表格与图表提取:支持将复杂表格转换为Markdown或HTML,将流程图、组织架构图转换为Mermaid代码。

- 多语言与手写支持:覆盖英语、中文、法语、西班牙语、日语等多种语言,对手写文档同样友好。

- 视觉问答功能:能够直接回答基于文档内容提出的问题,若文档中未提及答案,则回复“不提及”。

在应用层面,用户可通过API、transformers库或vLLM等多种方式灵活调用该模型。对于金融等包含复杂表格的文档,建议使用专门优化的“Markdown (Financial Docs)”模式。同时,提升输入图像的分辨率有助于显著提高识别准确率。

价值与影响

Nanonets-OCR2的出现,标志着文档处理从简单的文本提取迈向了深度的内容理解与结构化。它生成的标准化、语义化的Markdown输出,极大地便利了后续的大语言模型处理、知识库构建和自动化工作流集成。其开源特性也降低了技术应用门槛,为开发者社区提供了强大的工具,有望在学术研究、企业文档管理、金融分析等多个领域推动效率提升与流程自动化。

来源:黑洞资源笔记