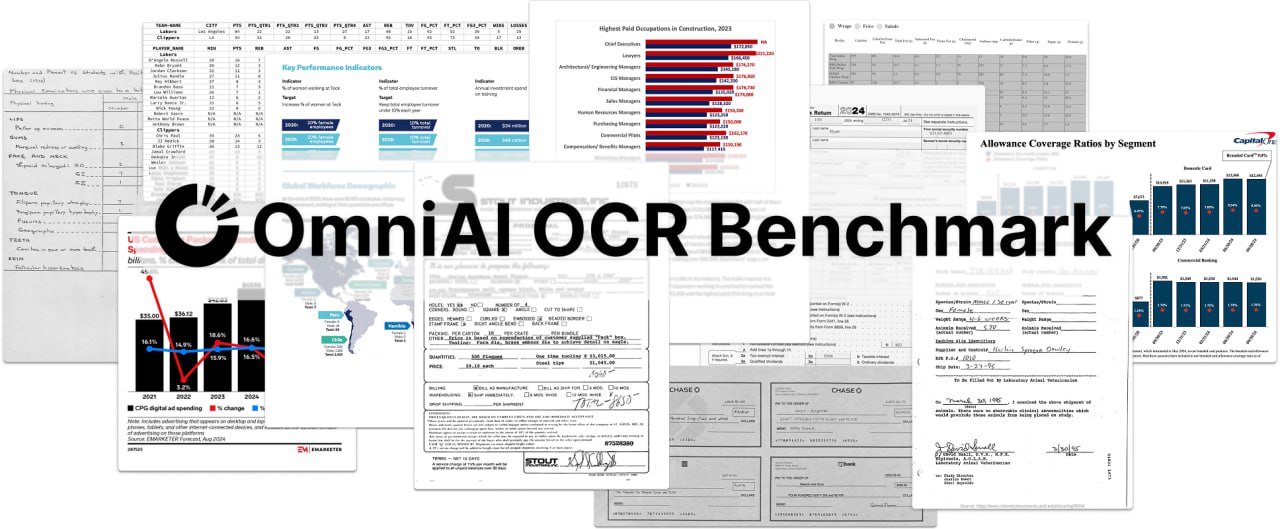

Omni OCR Benchmark:多模态模型 OCR 能力评估工具

Omni OCR Benchmark 是一个开源基准测试工具,旨在系统评估多模态模型在 OCR 和数据提取任务上的性能。它支持主流模型,并提供 JSON 准确率与文本相似度等关键指标。

在人工智能领域,多模态模型结合视觉与文本理解能力,在文档识别与信息提取(OCR)任务中展现出巨大潜力。然而,如何客观、量化地评估不同模型在此类任务上的性能,一直是开发者和研究者面临的挑战。一个标准化的评估基准对于模型选型、性能对比和技术迭代至关重要。

核心内容

Omni OCR Benchmark 应运而生,它是一个专门用于评估多模态模型 OCR 与数据提取能力的开源基准测试工具。该工具的核心功能围绕几个关键方面构建。

首先,它支持对多种主流多模态模型进行测试,例如 OpenAI 的 GPT-4o 和 Google 的 Gemini,为用户提供了横向比较的平台。

其次,评估体系细致全面。工具不仅关注传统的文本识别准确度,还特别强调了结构化数据提取的准确性,通过 JSON 准确率 这一指标进行衡量。同时,文本相似度 评估则用于量化模型输出与标准答案在语义和内容上的一致性。

最后,其开源特性构成了重要优势。项目提供了开源数据集,允许用户根据自身业务场景的需求,自由地对数据集进行扩展、定制或构建新的测试用例,从而使得评估更具针对性和实用性。

价值与影响

Omni OCR Benchmark 的出现,为多模态模型在 OCR 领域的应用提供了重要的评估标尺。通过标准化的测试流程和可量化的指标,它有助于开发者高效筛选出最适合特定任务需求的模型,减少试错成本。其开源和可扩展的设计,也鼓励社区共同贡献,不断丰富测试场景,共同推动多模态 OCR 技术向更精准、更可靠的方向发展。对于从事文档自动化、信息抽取等相关工作的技术团队而言,此类工具能有效提升技术选型与研发效率。

来源:黑洞资源笔记