ARQ:结构化推理方法显著降低 LLM 幻觉

Attentive Reasoning Queries (ARQ) 通过结构化 JSON 查询强制大型语言模型在多轮对话中逐步检查关键信息,在 87 个场景测试中取得了 90.2% 的成功率,有效缓解了模型遗忘规则...

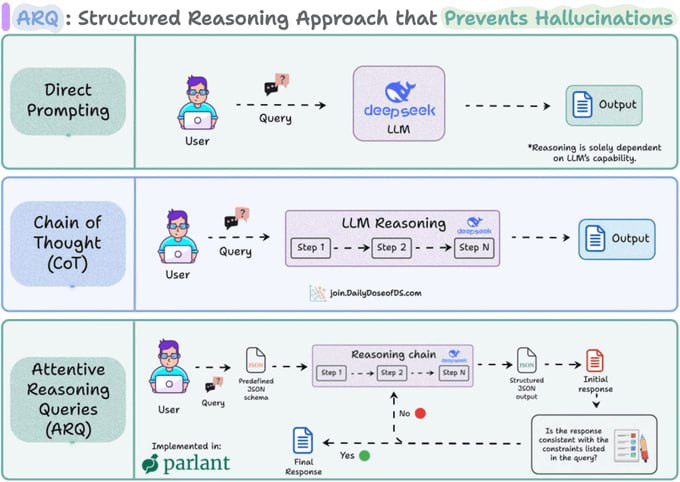

大型语言模型在处理复杂、多轮对话或需要严格遵守预设规则的高风险任务时,常出现“幻觉”问题。具体表现为模型在对话过程中逐渐遗忘或偏离最初设定的关键规则与上下文,例如无法持续遵守长达数千字的系统提示。传统的 Chain-of-Thought 等推理方法虽然允许模型自由思考,但缺乏对特定领域规则的严格控制,导致其在需要精确遵循指令的场景中效果有限。

核心内容

近期开源的 Attentive Reasoning Queries (ARQ) 方法,为解决上述问题提供了一种结构化思路。其核心在于将推理步骤强制结构化为一系列明确、且具备领域针对性的 JSON 格式查询。模型在生成最终答复前,必须逐步回答这些预设问题,以检查和确认关键信息。

一个典型的 ARQ JSON 查询可能包含以下字段:当前对话上下文、当前激活的指导原则、是否已采取过某项行动、是否需要调用外部工具以及下一步建议操作等。这种设计强制模型在每一步推理中都“有据可依”,从而在多轮对话中保持对核心规则的一致关注。

根据公开的测试结果,ARQ 在涵盖 87 个场景的评估中取得了 90.2% 的成功率,显著优于 Chain-of-Thought 的 86.1% 和直接生成的 81.5%。目前,该方法已被集成到开源框架 Parlant 中,覆盖了指导规则选择、工具调用和最终回复生成等关键模块。

价值与影响

ARQ 的价值在于它提供了一种可审计、可验证的推理框架。通过将隐式的推理过程显式化、结构化,不仅提升了模型在复杂任务中的行为可控性和可靠性,也为开发者调试和优化模型行为提供了清晰的路径。这项研究提示,在需要高准确性和一致性的应用场景中,明确、结构化且感知领域知识的推理方法,比完全自由的“思考”更为可靠。尽管自由形式的推理适合创造性任务,但严谨的框架是确保模型行为符合预期、减少幻觉的关键。该方法已通过 Parlant 框架开源,可供社区进一步研究和应用。