大模型面试题及答案 GitHub 资源分享

本文介绍一个在 GitHub 上开源的大模型面试题与答案集合仓库,旨在为相关领域的学习者和求职者提供参考。

随着大语言模型技术的快速发展,相关领域的人才需求日益增长,面试准备成为许多开发者和研究者的重要环节。近期,一个名为“大模型面试题及答案”的 GitHub 仓库在技术社区中被分享,旨在汇集相关面试问题与参考答案。

核心内容

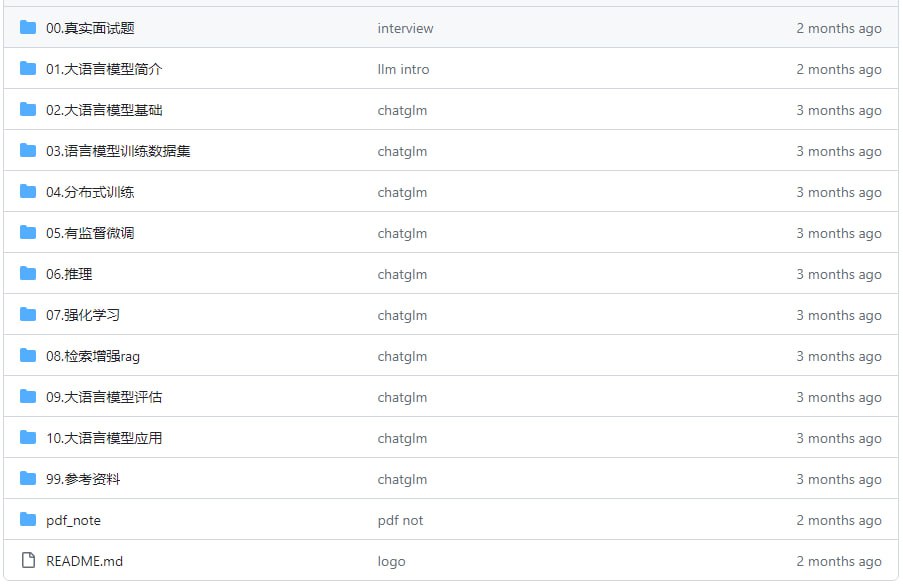

该资源由用户 wdndev 维护,以 GitHub 仓库的形式公开。仓库内容主要围绕大模型相关的面试题目及其答案展开,为学习者提供了一个结构化的参考集合。资源通过“黑洞资源笔记”这一渠道被传播和分享。

价值与影响

此类开源资源降低了获取专业面试资料的门槛,有助于求职者系统性地梳理知识体系,也为技术社区的知识沉淀与共享提供了便利。开发者可以直接访问仓库链接进行查阅和学习。