Awesome AI Efficiency:AI 效率优化全景指南

TechFoco 精选

本文介绍了 Awesome AI Efficiency 资源库,该库系统梳理了量化、剪枝、蒸馏等模型压缩与推理优化技术,旨在构建更高效、环保的 AI 系统,并集成了相关工具与学习资源。

随着人工智能模型规模与复杂度的持续增长,其计算需求与能源消耗已成为不可忽视的挑战。单次 AI 查询的能耗可能高达 3 至 40 瓦时,面对海量用户请求,其背后的环境代价与运营成本急剧攀升。在此背景下,提升 AI 效率、推动绿色计算,从研究探索逐渐成为产业实践的迫切需求。

核心内容

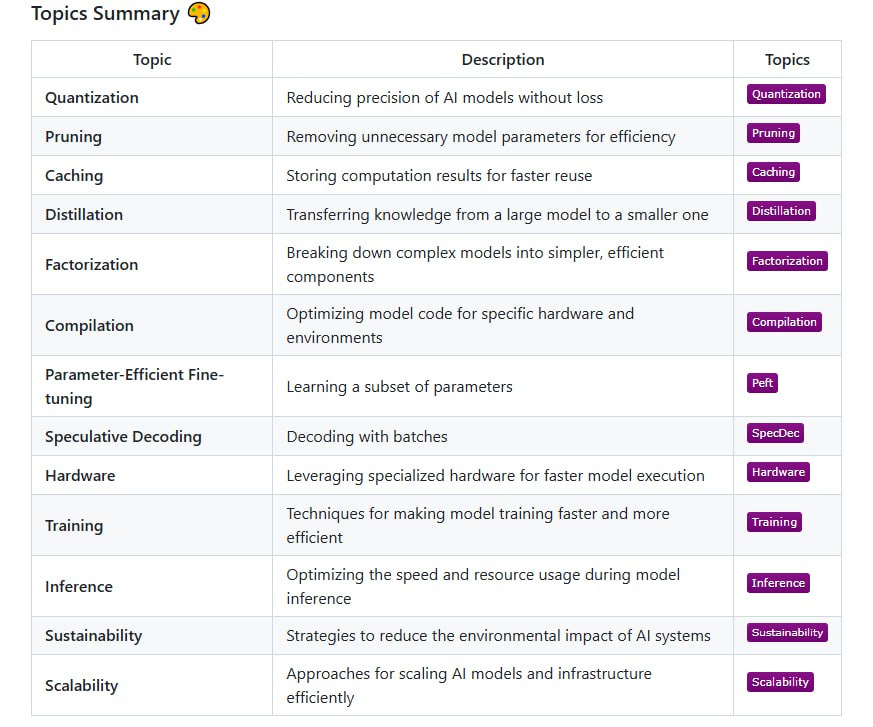

Awesome AI Efficiency 资源库为此提供了一个系统性的全景指南。其核心内容围绕一系列关键技术展开,旨在打造更快、更小、更环保的智能系统。

指南涵盖的主要技术路径包括:

- 模型压缩:如量化(Quantization)、剪枝(Pruning)、知识蒸馏(Knowledge Distillation),通过减少模型参数量或精度来降低计算负担。

- 推理优化:涉及缓存、编译、算子融合等技术,结合 TensorRT、ONNX 等运行时框架,提升模型执行效率。

- 系统级优化:关注专用硬件加速、训练过程优化以及多参数高效微调等方法。

此外,该资源库深度集成了 Pruna、Code Carbon 等多维度工具,为模型压缩与能耗监控提供实践支持。它不仅梳理技术,还提供了丰富的配套资源库,包括相关论文、行业报告、博客文章、书籍与课程,帮助开发者追踪最新进展与最佳实践。

价值与影响

该资源库的整合与发布具有多重价值。首先,它系统化地梳理了分散的 AI 效率优化技术,为研究者和工程师提供了清晰的学习路径与工具选择参考。其次,通过揭示 AI 高能耗现状并提供切实的优化方案,它直接回应了降低计算成本与减少环境影响的行业痛点,助力 Green AI 的发展。最终,这种集中化的知识沉淀有助于加速高效能 AI 系统的研发与部署,推动人工智能技术在性能与可持续性之间取得更好平衡。