本地 AI 模型 vs 云端订阅:成本与掌控权之战

本地AI模型性能强大,可处理90%开发任务。32GB内存即可流畅运行,实现隐私、零延迟与数字主权。但需投入工具链调试,并接受风扇噪音与续航代价。

TechFoco

共 2 篇文章,按时间倒序展示。

本地AI模型性能强大,可处理90%开发任务。32GB内存即可流畅运行,实现隐私、零延迟与数字主权。但需投入工具链调试,并接受风扇噪音与续航代价。

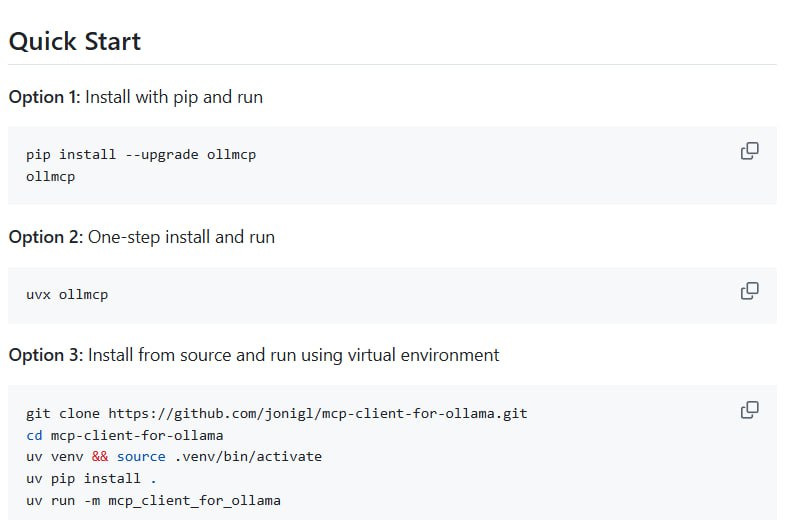

MCP Client for Ollama:本地LLM开发工具,支持多服务器并行、实时流式响应、工具管理及性能监控,提升开发效率与安全。