Open WebUI:功能丰富的自托管 AI 平台

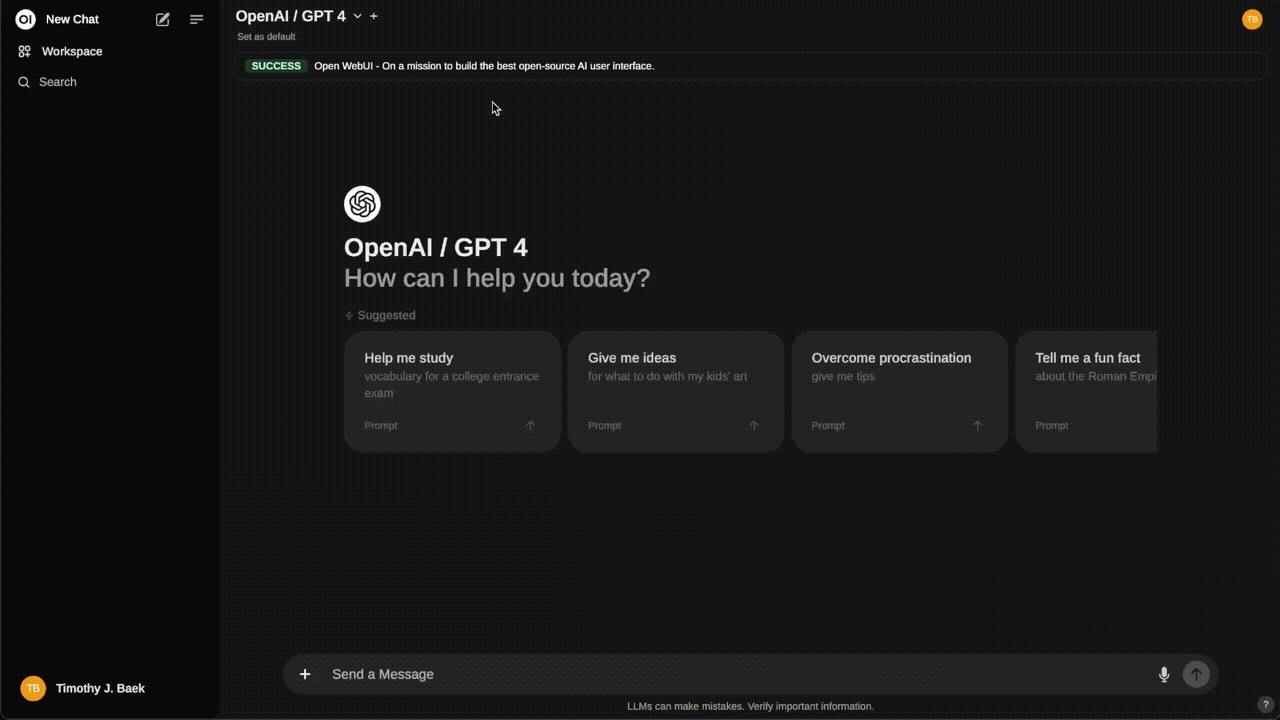

Open WebUI 是一个可扩展、功能丰富的自托管 AI 平台,支持完全离线运行。它集成了多种 LLM 运行器和 RAG 推理引擎,并提供 Docker 与 Kubernetes 等便捷部署方式。

随着大型语言模型(LLM)技术的普及,企业和开发者对能够自主控制、保护数据隐私且功能完备的 AI 部署平台需求日益增长。传统的云端 AI 服务虽然便捷,但在数据安全、定制化和离线运行方面存在局限。在此背景下,自托管 AI 平台成为了一种重要的技术解决方案。

核心内容

Open WebUI 是一个设计为完全离线运行的可扩展、功能丰富且用户友好的自托管 AI 平台。其核心能力主要体现在以下几个方面:

首先,在模型支持上,平台兼容多种 LLM 运行器。它原生支持 Ollama,同时也能够无缝集成各类 OpenAI 兼容的 API。用户可以通过自定义 OpenAI API URL,轻松连接 LMStudio、GroqCloud、Mistral、OpenRouter 等多种外部服务,极大地扩展了模型选择的灵活性。

其次,平台内置了用于检索增强生成(RAG)的推理引擎。这一特性使得 Open WebUI 不仅是一个简单的聊天界面,更能成为一个支持复杂知识库问答和文档分析的强大 AI 应用部署基础。

在部署与运维方面,Open WebUI 提供了便捷的安装体验。用户可以通过 Docker 或 Kubernetes(支持 kubectl、kustomize 或 helm 方式)进行无缝安装。平台镜像提供了 :ollama 和 :cuda 等标签,以满足不同硬件环境(如是否使用 GPU 加速)的需求,降低了部署的技术门槛。

价值与影响

Open WebUI 的出现为需要高数据隐私、定制化 AI 功能或离线运行环境的场景提供了可行的技术路径。其支持完全离线运行的特点,尤其适合对数据安全有严格要求的金融、医疗、科研及企业内部应用。通过集成 RAG 引擎和广泛的模型接口,它使得开发者能够基于统一的平台,快速构建和部署从简单对话到复杂企业级知识库的各种 AI 应用。其基于容器化技术的部署方案,也符合现代云原生应用的运维标准,便于集成到现有的 DevOps 流程中。总体而言,Open WebUI 降低了自托管 AI 系统的使用和部署复杂度,为更多组织将 AI 能力内化提供了工具支持。

来源:Parry