DeepSeek-OCR 辨析:Token 压缩与 LLM 嵌入空间冗余

本文探讨了 DeepSeek-OCR 技术成功背后的核心原因,指出其关键并非图像表示本身,而是揭示了大型语言模型嵌入空间存在的巨大冗余。通过对比剑桥大学的研究与 LIFT 论文的发现,论证了通过微调优化文本表示同样...

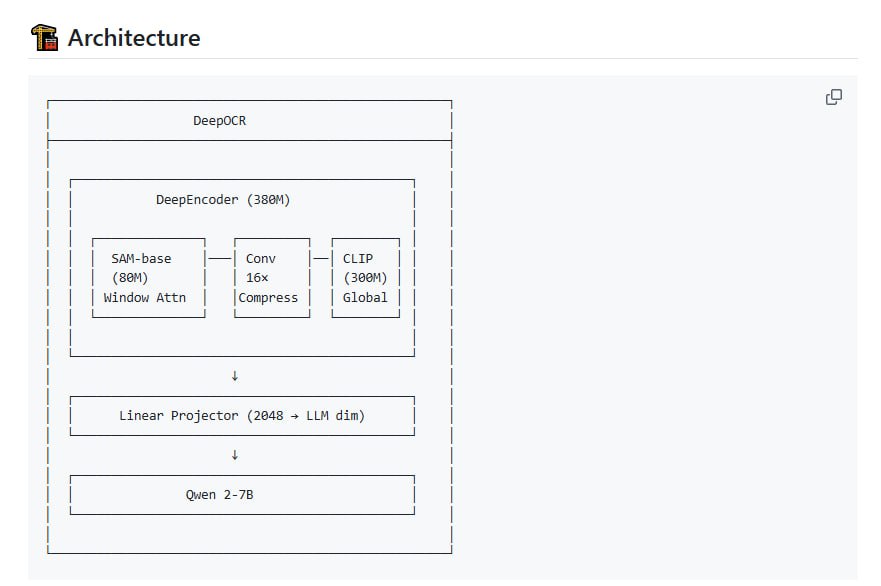

近期,DeepSeek-OCR 技术引发了广泛讨论,其通过将文本渲染为图像以实现 Token 压缩的思路备受关注。然而,许多解读可能过度聚焦于“图像表示”这一形式,而忽略了其背后更深层的技术启示。

核心内容

将文本渲染成图像以压缩 Token 并非全新的思路。DeepSeek-OCR 的成功不应简单归功于图像表示法的魔力。实际上,问题的关键不在于表示形式是文本还是图像。

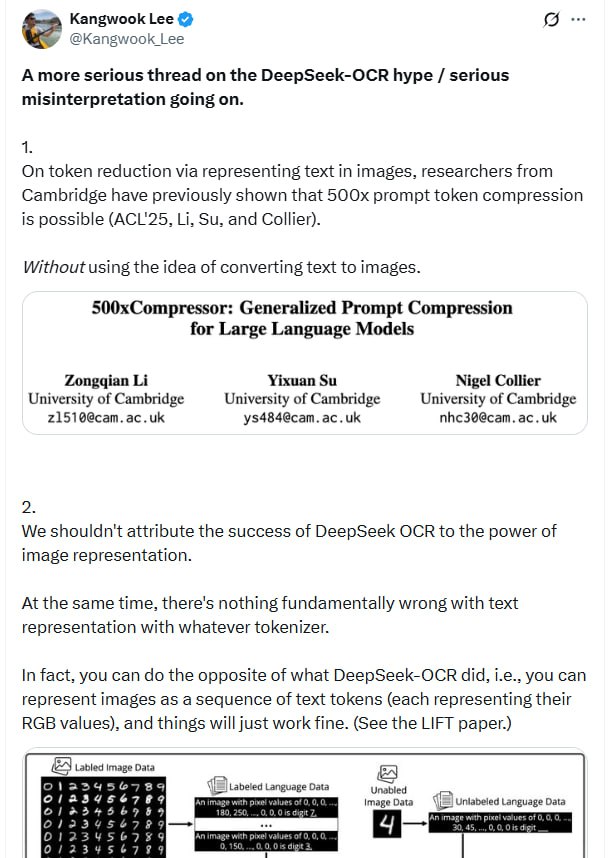

首先,Token 压缩本身并非新大陆。剑桥大学的研究者早已证明,通过对语言模型进行微调,使其适应“被压缩”的文本 Token,可以实现高达 500 倍的提示词压缩。这一成果未使用任何图像转换技术,表明优化文本自身表示同样潜力巨大。

其次,表示形式并非关键。我们可以反向操作,将图像表示为一系列文本 Token(例如,代表 RGB 值的序列),模型依然可以正常工作,LIFT 论文就证明了这一点。这说明,无论是文本还是图像,都只是一种编码信息的载体,没有哪一种具有根本性的优越性。

价值与影响

DeepSeek-OCR 等工作真正揭示的核心问题是,当前大语言模型的嵌入空间极其庞大,甚至可以说存在严重的冗余和浪费。我们远未充分利用这个高维空间,以及模型在推理时投入的巨大算力。

近期多项研究也支持这一观点。例如,有论文发现,如果在单一上下文中混合来自多个任务的示例,模型能够同时解决多个不同的上下文学习任务。这进一步证明了模型的上下文窗口和嵌入空间拥有超乎我们当前理解的容量和灵活性。

DeepSeek-OCR 是一项有价值的技术探索。但其实现的 Token 压缩效果,通过直接微调 LLM 处理优化的文本 Token 同样可以达到,甚至可能更高。这为未来优化模型效率、挖掘嵌入空间潜力提供了新的思考方向。