深度学习为何有效?——全息原理揭秘

本文探讨了深度学习有效性的一个理论视角,即其可能借鉴了物理学中的全息原理,通过张量网络结构将高维信息高效编码于低维表示中,从而实现强大的特征提取与泛化能力。

深度学习在计算机视觉、自然语言处理等领域取得了显著成功,但其为何能如此有效地从数据中学习,其背后的理论原理一直是研究热点。近期,有观点尝试从物理学中寻找答案,特别是借鉴了“全息原理”这一概念,为理解深度学习的工作机制提供了一个新颖的交叉学科视角。

核心内容

全息原理源于理论物理学,其核心思想是高维空间的信息可以被完整地编码在低一维的边界上。类比到深度学习中,复杂的、高维度的输入数据(如图像、文本)所蕴含的信息,可以通过神经网络被有效地压缩和表达在一个相对低维的表示空间中。

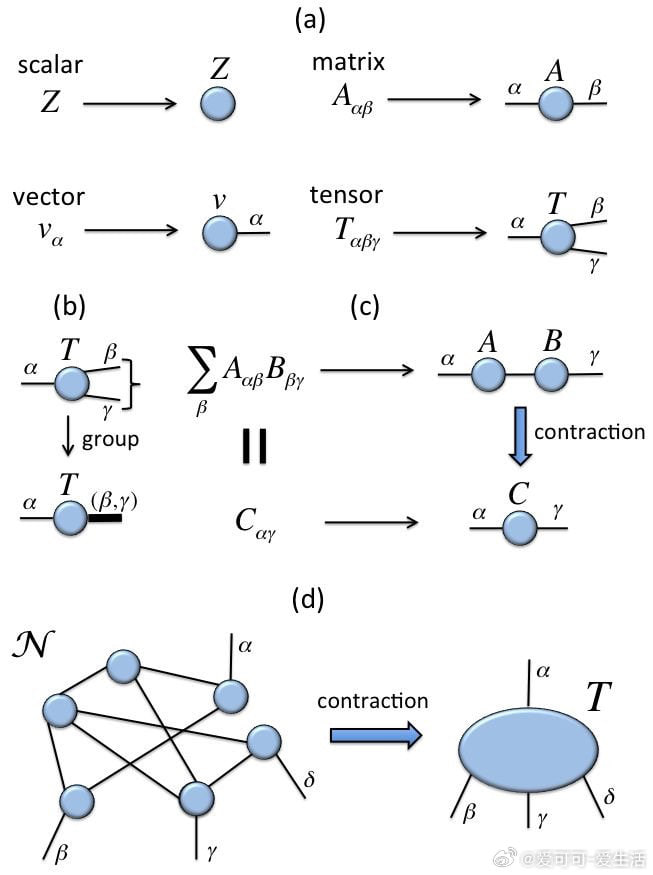

实现这一过程的关键数学结构是张量网络。神经网络中的权重、激活值等均可视为张量。其核心操作包括:

- 张量乘积与缩并:这些操作实现了网络中信息的融合与传递,本质上是进行特征抽取和变换。

- 网络结构:层与层之间的复杂连接关系,可以通过张量的缩并运算来描述,从而构成了一个高效的计算图。

通过这种张量网络结构,深度学习模型能够将原始高维数据映射为紧凑的、蕴含关键特征的内部表示。这个过程类似于制作全息图,将三维物体的信息记录在二维平面上,在需要时又能重建出丰富的细节。

价值与影响

从全息原理的角度审视深度学习,其价值在于提供了一种超越“黑箱”经验解释的理论框架。它强调了深度学习的力量并非仅仅源于模型的深度或参数规模,更在于其结构本身对信息的高效编码与解码能力。这种结构特性使得模型能够:

- 节省计算与存储资源,用相对紧凑的表示捕获数据本质。

- 获得更好的泛化能力,因为学习到的是数据的底层结构而非表面噪声。

这一视角将深度学习的有效性归结为对信息结构的“全息”把握,促进了计算机科学、物理学和数学在基础理论层面的交叉融合,为未来设计更高效、可解释的神经网络架构提供了启发。

来源:黑洞资源笔记