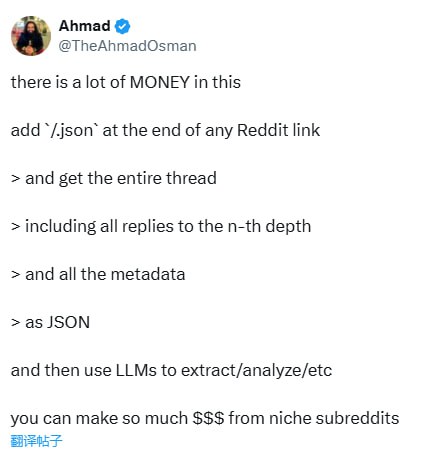

Reddit JSON 端点免登录数据抓取与 LLM 分析指南

本文介绍一种无需登录即可抓取 Reddit 完整讨论数据的技术方法:在链接后添加 /.json 后缀。该方法可直接获取深度嵌套的原始数据和元信息,结合 LLM 分析,适用于市场研究、内容策划等多种场景。

Reddit 作为全球知名的社区平台,汇聚了大量细分领域的深度讨论,是进行市场研究、趋势分析和用户洞察的宝贵数据源。然而,传统的 API 调用可能存在限制,手动抓取又效率低下。近期,一种通过简单修改 URL 即可直接获取结构化数据的方法受到关注,为自动化数据采集与分析提供了新的低门槛入口。

核心内容

该方法的核心操作极为简单:在任意 Reddit 帖子或讨论串的标准链接末尾,直接添加 /.json 后缀。例如,将 https://www.reddit.com/r/technology/comments/abc123/ 改为 https://www.reddit.com/r/technology/comments/abc123/.json。访问此链接,无需任何登录凭证,即可直接返回一个结构化的 JSON 数据响应。

该 JSON 数据包含了该讨论串的完整信息:原始帖子内容、所有层级的用户回复、投票数、发布时间、作者等丰富的元数据。这些数据以嵌套的树状结构呈现,完整保留了讨论的脉络和上下文。

获取数据后,可以结合大语言模型(LLM)进行深度分析。典型应用场景包括:

- 情感分析与舆论监控:分析特定话题下社区的整体情绪倾向。

- 趋势预测与内容策划:识别新兴话题或用户普遍关心的问题,为内容创作提供方向。

- 市场研究与商业情报:在垂直细分社区中,挖掘用户痛点、产品反馈和潜在的市场机会。

自动化流程可以进一步结合其他工具,例如利用 Notion AI 等对分析结果进行总结,或自动化生成发帖时间建议、标题优化策略等。

价值与影响

这项技术的主要价值在于其低门槛和高灵活性。它绕过了官方 API 可能存在的调用限制或认证流程,仅需模拟常规浏览器请求头即可开始采集,极大简化了数据获取步骤。对于开发者、数据分析师和市场营销人员而言,这开启了一扇直接通往海量、高质量社区原生数据的大门。

然而,在实际应用中需注意两点:一是应合理控制抓取频率,避免对目标服务器造成压力或触发反爬机制;二是 Reddit 社区文化多元,用户群体差异大,分析时需要精准定位目标子版块,理解其特定语境。

最终,公开的数据本身价值有限,真正的商业价值源于从“海量噪声”中提炼出精准、可执行的用户洞察,并将其转化为具体的产品优化策略、内容方案或市场决策。这种方法将数据获取与分析的门槛降低,使更多团队能够基于真实的社区反馈进行快速迭代与验证。