Astra Assistant API Service:兼容 OpenAI Assistants API 的后端实现

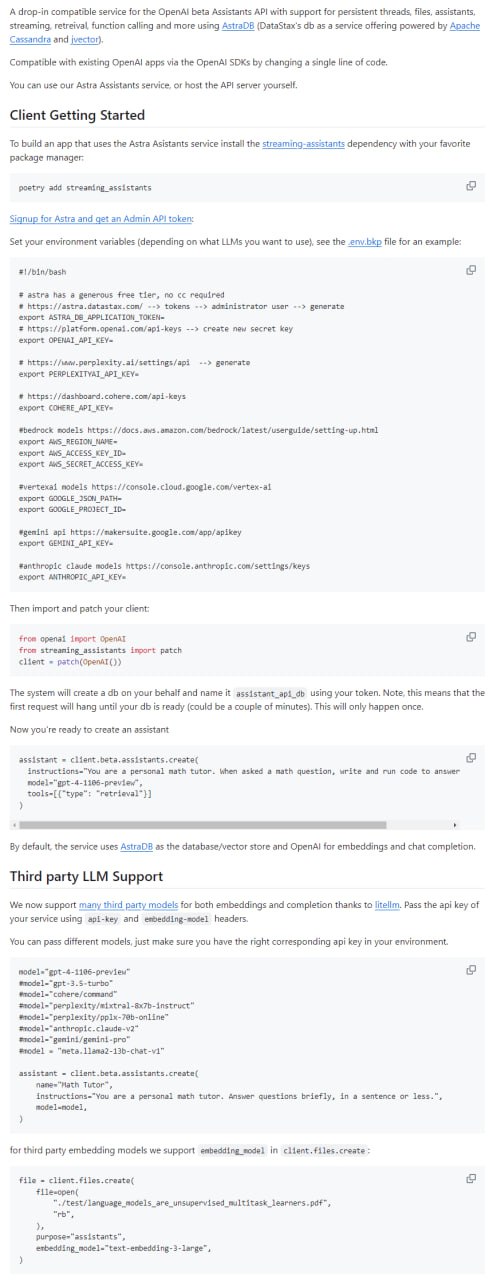

Astra Assistant API Service 是一个与 OpenAI beta Assistants API 兼容的后端实现,支持持久线程、文件、助手、流式处理、检索和函数调用等功能,并使用 AstraD...

在构建基于大型语言模型(LLM)的智能应用时,开发者常常需要处理对话状态管理、文件处理、知识检索等复杂任务。OpenAI 推出的 beta Assistants API 为此提供了一套标准化的接口,但其后端实现通常需要开发者自行搭建和维护。DataStax 推出的 Astra Assistant API Service 正是针对这一需求,提供了一个开源的、与 OpenAI 标准兼容的后端服务实现。

核心内容

Astra Assistant API Service 的核心目标是提供一个功能完备的后端,以兼容 OpenAI beta Assistants API 的规范。这意味着开发者可以遵循 OpenAI 的 API 调用方式,无缝地将后端服务替换为 Astra 的实现。

该服务支持 Assistants API 的一系列关键功能:

- 持久化状态管理:支持持久的线程(Threads),确保对话上下文在多次交互中得以保留。

- 多模态支持:能够处理和管理文件,为助手提供额外的上下文信息。

- 助手定义与调用:允许创建和配置具有特定指令和功能的 AI 助手。

- 流式响应:支持流式处理(Streaming),实现更实时的交互体验。

- 检索增强生成(RAG):内置检索(Retrieval)功能,能够从知识库中查找相关信息以增强回答的准确性。

- 函数调用:支持函数调用(Function Calling),使助手能够执行外部工具或自定义逻辑。

在技术栈上,该服务选择使用 DataStax 自家的 AstraDB 作为底层存储。AstraDB 在此扮演双重角色:既作为传统的关系型数据库,用于存储线程、助手元数据等信息;也作为向量数据库(Vector Store),高效处理检索功能所需的向量相似性搜索。

价值与影响

Astra Assistant API Service 的出现为开发者提供了一个重要的基础设施选项。对于已经在使用或计划采用 OpenAI Assistants API 范式的团队,此服务提供了一个可自托管、可审查且与云服务商解耦的后端方案。它降低了构建复杂 AI 助手的门槛,开发者无需从零开始实现状态管理、文件处理和向量检索等通用模块。

同时,深度集成 AstraDB 也展示了向量数据库在现代 AI 应用架构中的核心地位。这种将标准化 API 接口与高性能专用数据库结合的模式,有助于推动 AI 应用开发向更模块化、更专业化的方向发展。该项目作为开源实现,也为社区理解和完善 Assistants API 的后端架构提供了参考。