深度学习隐藏的底层逻辑:顿悟与隐式正则化

深度学习正从工程经验向科学理论跨越。隐式正则化、信息压缩与归纳偏置等底层逻辑逐渐清晰,解释了顿悟现象。当前工程进步远超理论理解,理解这些机制对高风险领域应用至关重要。

深度学习正从工程经验向科学理论跨越。尽管行业倾向于通过增加算力和数据来解决问题,但关于“为什么神经网络有效”的底层逻辑——如隐式正则化、信息压缩与归纳偏置——正逐渐清晰。

当前 AI 领域有点像早期的电学时代:我们已经能造出极其复杂的电路(大模型),甚至能用它们实现各种惊人的功能,但对于电流究竟是怎么流动的,还没有一套完美的物理定律。

核心内容

隐式正则化与信息压缩

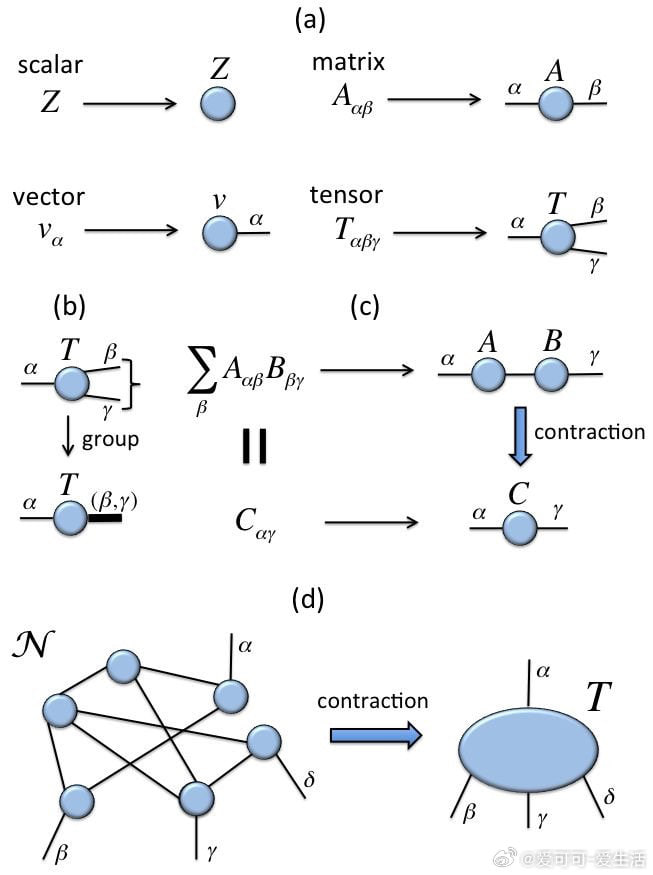

神经网络之所以比传统模型更强,秘密可能藏在“压缩”里。类似于 L1 正则化的机制能迫使模型用最少的比特去编码数据分布,这种隐式正则化其实是一种高效的信息压缩。

顿悟现象

这解释了为什么模型在经历一段看似毫无进展的训练后,会突然产生“顿悟”(Grokking)现象。模型在训练中可能经历顿悟,即看似无进展后突然性能提升,这与隐式正则化有关。

工程与理论的差距

现在的争议在于,我们是在“工程”深度学习,还是在“发现”它。有人觉得神经网络就像面向对象的编程,好用但没人懂底层逻辑;也有人担心,如果我们不能理解模型产生“幻觉”的数学本质,就永远无法在医疗或航空等高风险领域使用它。

我们正处于一个奇特的节点:工程进步的速度远超理论理解。这就像在还没弄懂热力学定律之前,人类就已经造出了蒸汽机。

价值与影响

问题的核心不在于模型有多大,而在于我们能否通过数学,把那些隐藏在海量参数里的“归纳偏置”找出来。理解模型产生幻觉的数学本质对于高风险领域应用至关重要。

有观点认为,这本质上是“苦涩的教训”:规模(Scaling)胜过一切复杂的架构设计。但这种看法忽略了一个关键点:如果只是单纯的参数堆砌,为什么同样规模的参数,换一种架构就完全不行?

深度学习正从工程经验向科学理论跨越,隐式正则化、信息压缩与归纳偏置等底层逻辑逐渐清晰。