从零构建微型 vLLM:探究大模型推理优化

TechFoco 精选

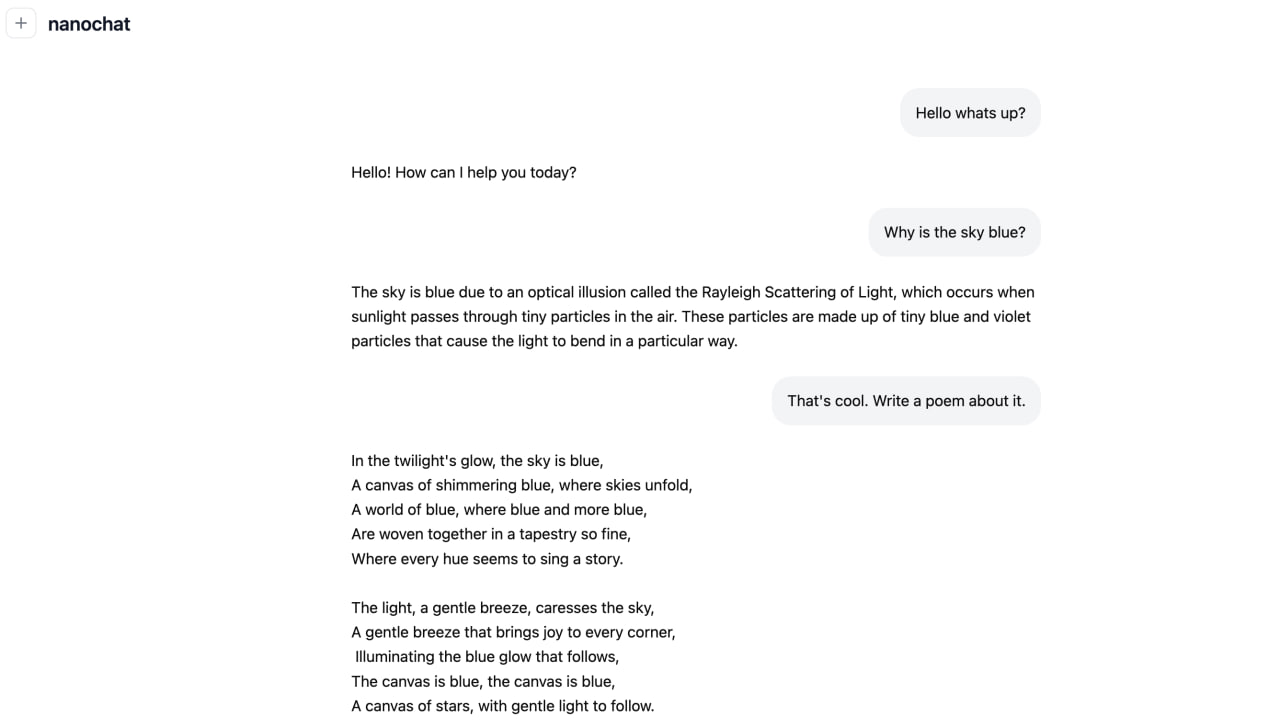

本文通过一个教学项目 nano-vllm,拆解了高性能大语言模型推理引擎 vLLM 的关键优化技术,以模块化代码帮助读者理解其工程实现。

随着大语言模型(LLM)应用的普及,其推理阶段的性能与效率成为工程实践中的关键挑战。vLLM 作为一个高性能的推理引擎,通过一系列优化技术显著提升了吞吐量。为了深入理解这些优化背后的原理,一个名为 nano-vllm 的教学项目被创建出来。

核心内容

nano-vllm 项目旨在从零构建一个微型版本的 vLLM,以此拆解和阐释原版推理引擎的核心优化点。该项目采用模块化的代码结构,将复杂的技术分解为可独立理解的部分。

关键技术拆解通常涉及以下几个方面:注意力机制的高效计算、KV 缓存的优化管理,以及批处理请求的调度策略。通过实现这些组件的简化版本,项目清晰地展示了如何减少内存占用并提高计算效率。

价值与影响

nano-vllm 作为一个教学工具,其价值在于降低了理解高性能推理引擎的门槛。开发者可以通过对照其模块化代码,直观地把握 vLLM 等系统在工程优化上的具体思路,为后续的深入研究和实际应用开发奠定基础。