在手机上微调并本地部署大型语言模型

Unsloth AI 与 PyTorch 合作推出新方案,支持在 iOS 和 Android 手机上微调并 100% 本地运行 LLM,实现移动端高效推理与隐私安全。

随着大型语言模型(LLM)能力的不断提升,其应用正从云端服务器向边缘设备扩展。传统的模型训练和推理通常依赖于强大的云端算力,这不仅带来了延迟和成本问题,也引发了用户对数据隐私的关切。将 AI 能力下沉到终端设备,实现本地化的训练与推理,已成为推动 AI 普及和隐私保护的重要方向。

核心内容

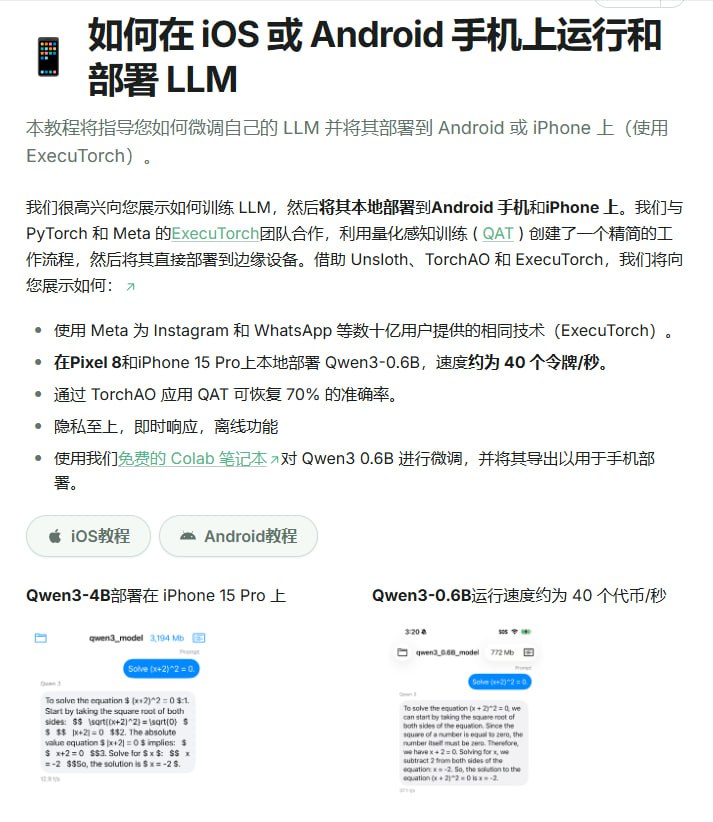

近期,Unsloth AI 联合 PyTorch 推出了一项新的技术方案。该方案支持用户在手机上对大型语言模型进行微调,并能够将训练好的模型导出,实现 100% 的本地部署与运行,兼容 iOS 和 Android 设备。

在性能表现方面,以 Qwen3 模型为例,在 Pixel 8 和 iPhone 15 Pro 等现代智能手机上,推理速度可以达到约 40 tokens/秒。这一速度使得在移动端进行高效的 AI 交互成为可能。

这项技术的核心价值在于,它将手机从一个单纯的应用终端,转变为一个集模型训练与推理于一体的完整 AI 环境。用户无需将数据上传至云端,从而在根本上减少了对云服务的依赖,并显著提升了隐私安全性。

价值与影响

该方案的推出,标志着 AI 向“边缘智能”迈出了关键一步。它降低了个人定制和使用强大 AI 模型的门槛,使得用户能够随时随地根据自身需求进行模型调整,真正实现了 AI 的个人化和隐私优先。

从技术发展角度看,未来该方案有望支持更多种类的模型,并探索多设备协同部署的可能性。同时,其应用范围也可能从当前的文本生成,扩展到音乐生成等多模态领域。此外,模型量化(如 QAT)等优化技术的进一步应用,将持续推动移动端 AI 在性能和能效方面的突破。