FullFront:MLLM 前端工程基准测试平台

FullFront 是一个针对多模态大语言模型的前端工程基准测试平台,覆盖设计、理解与代码生成三大核心任务,并提供包含图像渲染与多维度指标分析的自动化评估流水线。

随着多模态大语言模型(MLLM)在前端工程领域的应用日益广泛,如何系统、客观地评估模型在视觉设计理解、布局规划与代码生成等方面的能力,成为推动技术发展的关键。目前,业界缺乏一个覆盖前端工程全流程的综合性基准测试工具。

核心内容

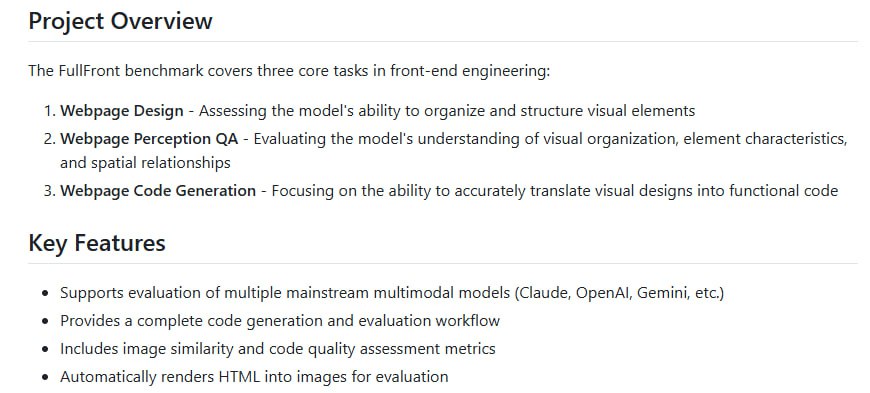

FullFront 平台应运而生,旨在为 MLLM 的前端工程能力提供系统化评估。该平台主要围绕三大核心任务构建评测体系:

- 网页设计:评估模型对视觉元素的组织与页面结构的规划能力。

- 网页感知问答:检测模型对页面视觉布局、元素特性及空间关系的理解深度。

- 网页代码生成:考察模型将视觉设计精准转化为功能性代码的水平。

平台支持对 Claude、OpenAI、Gemini 等主流多模态模型进行性能评测。其核心在于提供了一套完整的自动化评估流水线。该流水线能够自动将模型生成的 HTML 代码渲染成图像,方便与原始设计进行直观比对。评估过程融合了多维度指标,包括基于 CLIP 的图像语义相似度、代码结构相似度以及代码内容相似度,从而对模型表现进行深入解析。此外,平台提供了丰富的脚本,支持批量多模型响应生成与自动化评估流程。

价值与影响

FullFront 为量化评估多模态大语言模型在前端工程领域的智能水平提供了标准化工具。通过其系统化的测试任务与多维度的评估指标,研究人员与开发者能够更精准地测量不同模型的性能差异,洞察模型在特定任务上的优势与不足。这有助于引导模型能力的持续优化,并推动前端智能化开发工具向更可靠、更高效的方向发展。

来源:黑洞资源笔记