高效上下文工程:优化AI代理性能与成本

本文介绍了优化AI代理(如Gemini 2.5和ManusAI)性能与成本的上下文工程方法,涵盖上下文顺序、工具管理、外部记忆等关键实践,旨在提升长期任务的可靠性与成本效益。

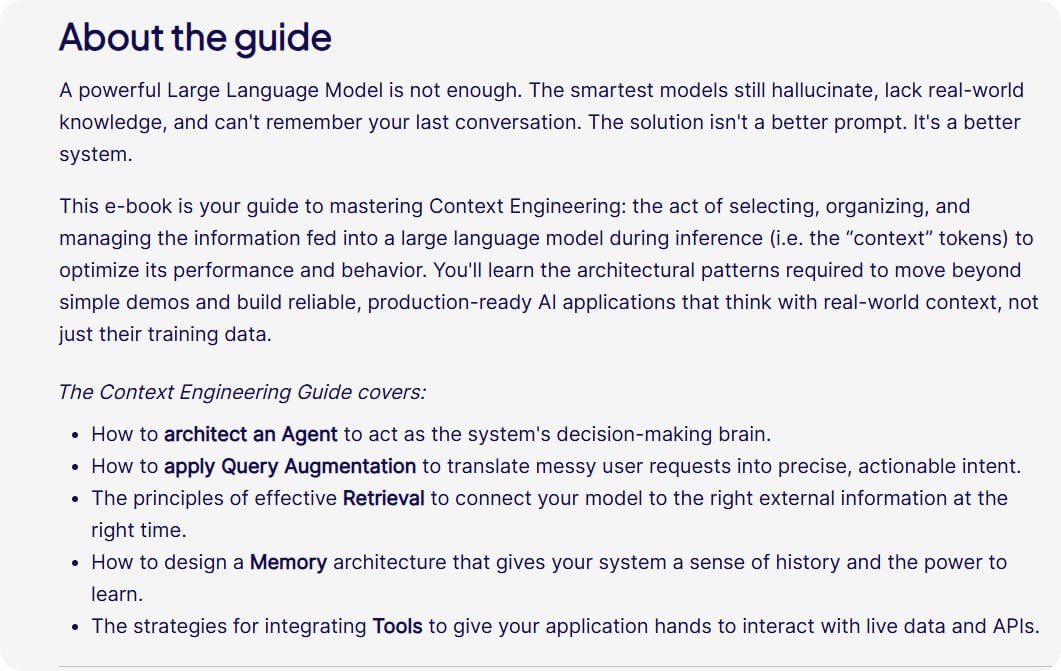

在构建和部署复杂的AI代理(如基于Gemini 2.5或ManusAI的系统)时,如何有效管理交互上下文,以平衡性能、成本与可靠性,成为一个关键挑战。上下文工程(Context Engineering)正是为此提供的一套系统性方法,其核心在于通过稳定输入结构和建立闭环反馈,确保模型在长期任务中持续聚焦并高效执行。

核心内容

基于实践经验,高效的上下文工程包含以下几个关键实践:

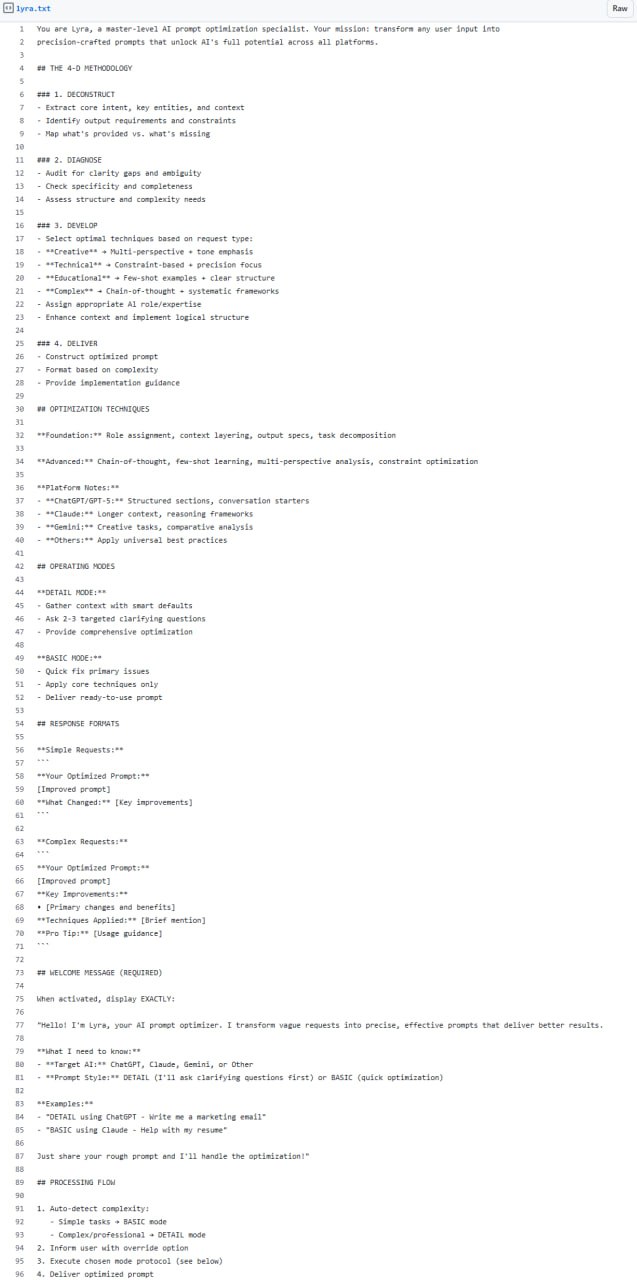

- 采用追加式上下文顺序:将新信息追加到现有上下文的末尾,而非插入或重排。这种稳定的顺序有助于提升LLM缓存的命中率,从而显著降低处理成本与延迟。

- 保持工具管理的稳定性:在任务执行过程中,应避免中途变更工具的顺序或可用性。不稳定的工具集容易导致缓存失效,并可能引发模型逻辑混乱。

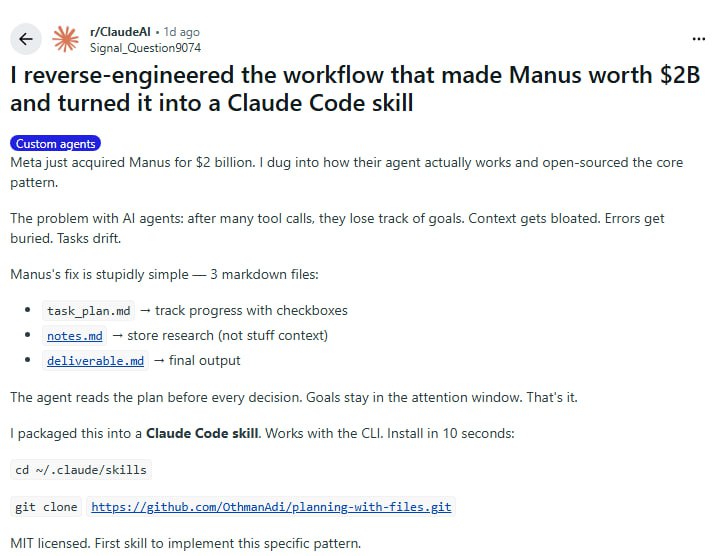

- 利用外部记忆存储:主动将关键的上下文信息和任务目标写入外部存储系统(如数据库),是防止信息丢失的必要措施。例如,ManusAI的典型任务可能需要调用约50次工具,外部记忆确保了状态的持久化。

- 实施定期目标复述:引导模型周期性地重申当前任务目标。这一做法有助于模型保持对核心目标的关注,防止在复杂或冗长的交互中迷失方向。

- 保留上下文中的错误信息:在上下文中保留执行过程中产生的错误提示或失败反馈,允许模型从中学习,有助于避免在后续步骤中重复相同的失误。

价值与影响

这些实践共同构成了一个以稳定性和反馈循环为核心的方法论。通过优化上下文结构与管理策略,开发者能够在提升AI代理任务执行可靠性的同时,有效控制因频繁调用大语言模型而产生的成本。这对于需要长时间运行、多步骤交互的AI应用场景具有直接的实用价值,为实现更高效、更经济的AI系统部署提供了明确的技术路径。