开源大模型使用指南:从部署到微调

本文介绍一个面向国内初学者的开源大模型教程项目,该项目基于 AutoDL 平台,提供了从环境配置、本地部署到高效微调的全流程实践指导,旨在降低开源大模型的使用门槛。

随着大型语言模型(LLM)技术的快速发展,开源模型为研究者和开发者提供了宝贵的资源。然而,对于国内许多初学者而言,从环境配置到实际应用开源大模型仍存在较高的技术门槛。资源获取、计算成本以及复杂的部署流程常常成为阻碍。为此,一个专门面向国内学习者的教程项目应运而生,旨在提供清晰、可操作的实践路径。

核心内容

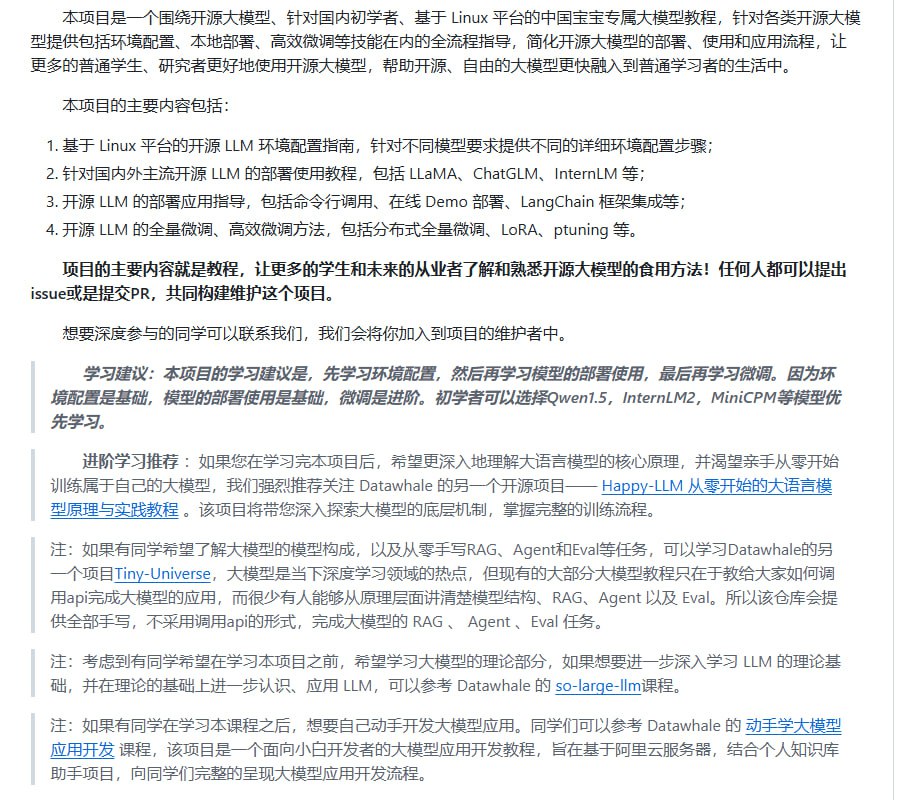

该项目是一个围绕开源大模型、针对国内初学者的教程,其核心内容基于 AutoDL 平台(方案可扩展至阿里云等平台)展开。教程体系覆盖了使用开源大模型的关键环节。

首先,项目提供了详细的环境配置指南,针对不同开源模型的具体要求,给出了差异化的环境搭建步骤,为后续操作奠定基础。

其次,教程涵盖了国内外主流开源 LLM 的部署与实践,例如 LLaMA、ChatGLM、InternLM 等模型。具体指导内容包括命令行调用、在线 Demo 部署以及如何与 LangChain 等框架进行集成,帮助用户快速将模型运行起来并接入应用流程。

在模型定制方面,项目介绍了全量微调与高效微调两类方法。内容涉及分布式全量微调,以及 LoRA、P-Tuning 等参数高效微调技术,为用户根据自身数据和算力资源调整模型行为提供了技术选项。

价值与影响

该教程项目的主要价值在于其针对性和实用性。它精准服务于那些希望使用或体验 LLM 但无法直接获得商用 API、追求长期低成本应用、或有意打造领域专属模型的学习者与研究者,尤其是广大的学生群体。通过提供从环境配置到高级微调的全流程指导,项目显著简化了开源大模型的部署、使用和应用流程。这有助于推动开源、自由的大模型技术更快速、更广泛地融入普通学习者和开发者的学习与研究实践中,降低技术应用的门槛,促进创新。

来源:黑洞资源笔记