LLM 幻觉根源:不到 0.1% 的神经元在作祟

中国研究者发现,LLM 中不到 0.1% 的特定神经元(H-Neurons)可预测幻觉,其根源在于预训练和微调的激励机制鼓励模型“过度顺从”。

TechFoco

共 4 篇文章,按时间倒序展示。

中国研究者发现,LLM 中不到 0.1% 的特定神经元(H-Neurons)可预测幻觉,其根源在于预训练和微调的激励机制鼓励模型“过度顺从”。

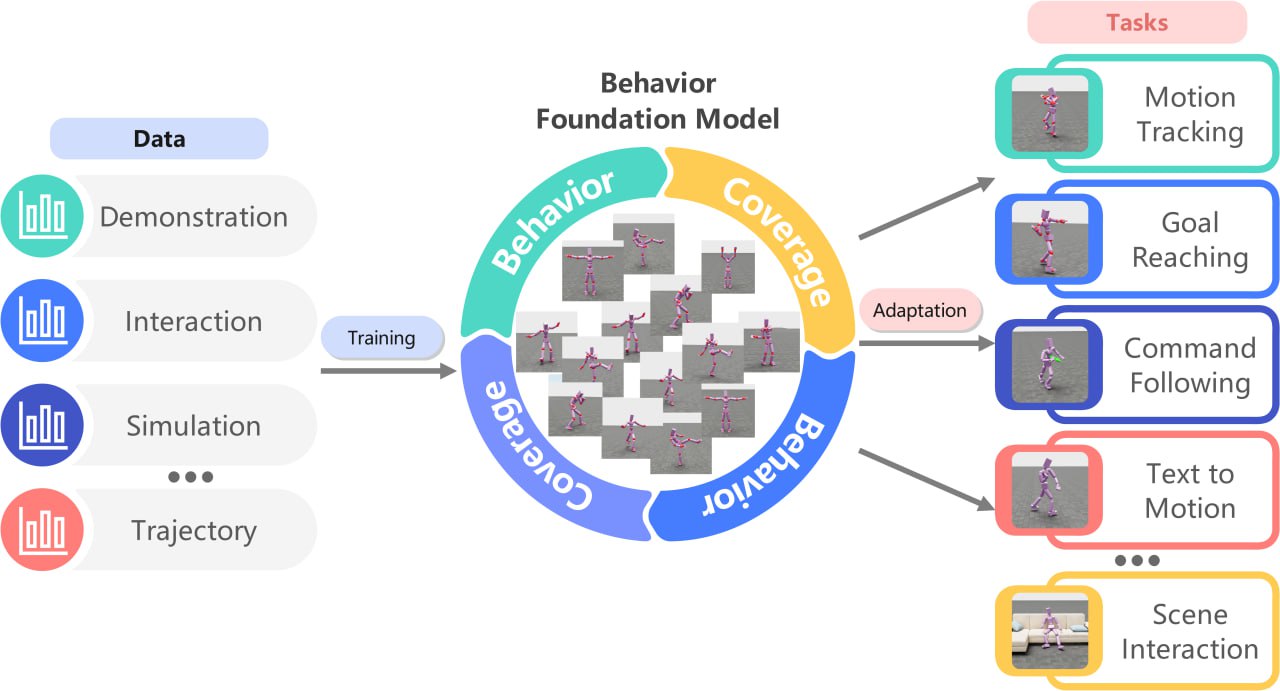

GitHub 资源库 awesome-bfm-papers 系统性地整理了行为基础模型领域的学术论文、教程与代码,为相关研究者和开发者提供了集中的学习与研究入口。

本文介绍一个旨在以可控成本构建小参数量聊天模型的 GitHub 项目。该项目已完成预训练和指令微调阶段,使用 bert4torch 框架,优化了内存占用,并支持与 Transformers 无缝衔接推理。

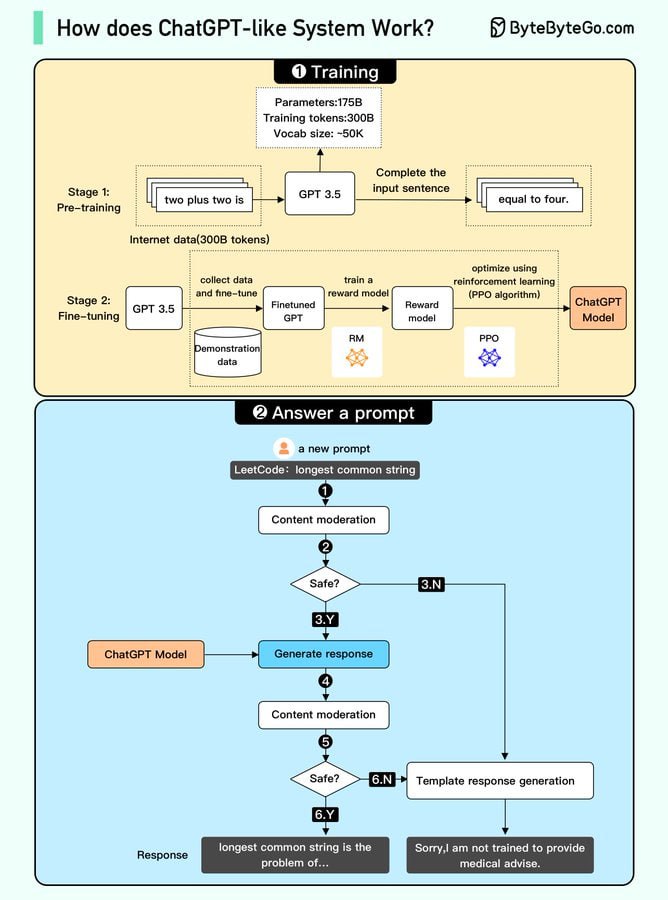

本文解析了类似 ChatGPT 的系统如何工作,主要分为模型训练与用户问答两个核心流程。训练阶段包括预训练和基于人类反馈的强化学习微调;问答流程则重点阐述了内容审核机制对输入与输出的双重安全保障。