OpenCode 隐私争议:标榜本地运行的工具被指存在隐藏的网络依赖

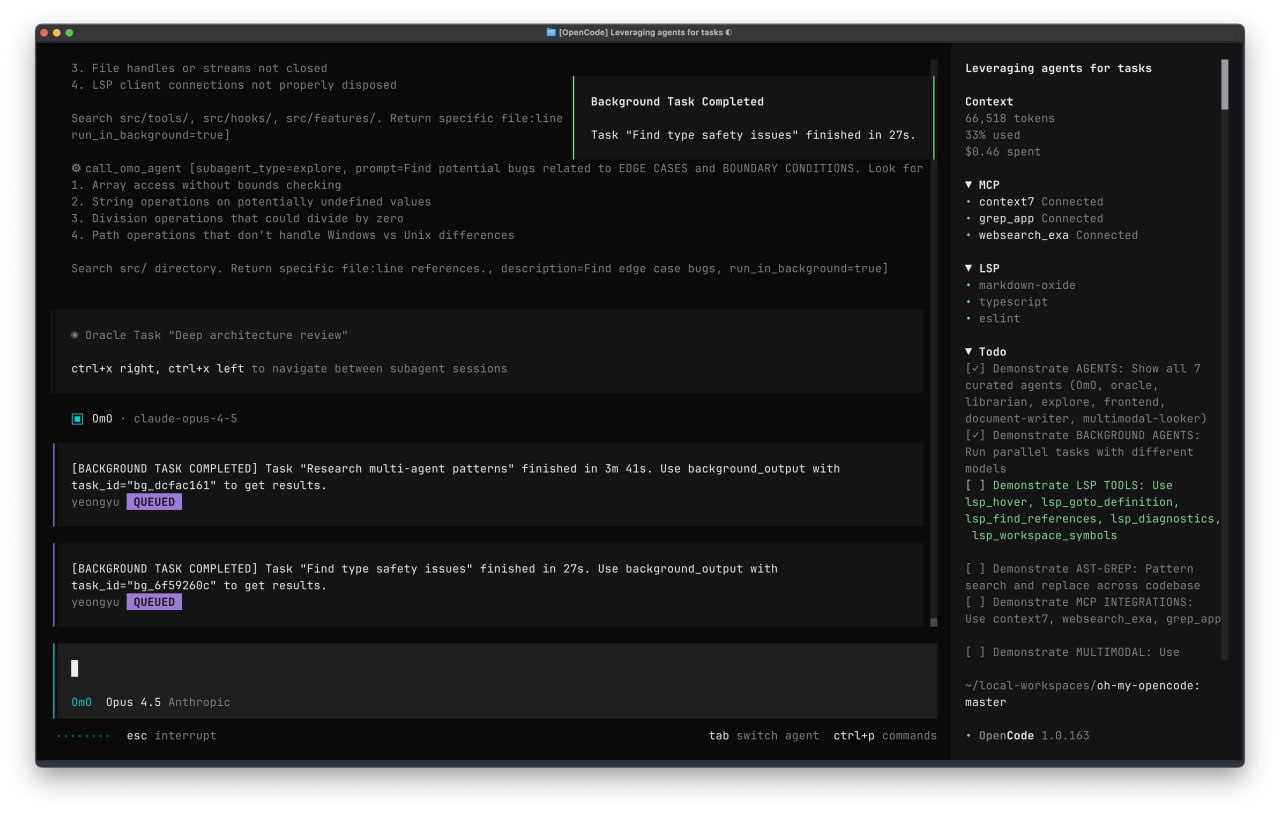

OpenCode 工具虽宣称支持本地运行,但社区发现其 Web UI 默认将所有请求代理至外部服务器且无法关闭,即使用户选择本地模型,部分功能仍会向远程服务器发送数据,引发了关于隐私和“本地”定义准确性的讨论。

在追求数据隐私和可控性的本地 AI 开发领域,工具的“本地运行”承诺至关重要。近期,围绕开发工具 OpenCode 的讨论在 Reddit 等社区发酵。用户发现,这款标榜“本地运行”的工具,其实际行为与宣传存在显著差异,核心争议点在于其隐藏且无法禁用的网络连接行为。

核心内容

根据社区用户的调查和代码分析,OpenCode 主要存在以下几个问题:

-

强制代理与网络依赖:运行

opencode serve启动 Web UI 后,所有用户请求默认被代理至app.opencode.ai服务器。关键之处在于,此代理行为没有提供启动参数或选项供用户关闭。在完全断网或严格防火墙环境下,工具启动会卡住或功能残缺。 -

隐蔽的数据上传:即使用户明确选择并运行本地模型,工具在启动时仍会将初始 prompt 上传至

opencode.ai/zen/v1/responses端点以生成会话标题。除非手动指定small_model,否则此行为无法避免,这与官方文档的描述不符。 -

广泛的远程连接:一个旨在本地运行的工具,在运行时静默连接了多个外部服务器。根据其分支项目 RolandCode 所删除的端点列表,这些连接包括:

us.i.posthog.com(用于使用分析)api.honeycomb.io(用于收集遥测数据、IP、位置)api.opencode.ai(涉及会话内容、prompts)opencode.ai/zen/v1(prompts 代理)app.opencode.ai(全局代理)

-

不受控的静默更新:即使用户在设置中关闭了自动更新,Web UI 仍会进行静默升级。这可能导致新的模型提供商突然出现在列表中,甚至被设置为默认选项,有用户因此意外产生了 OpenRouter 的 API 调用费用。

社区观点认为,这些并非程序缺陷,而是有意为之的设计选择。OpenCode 项目获得风险投资支持,但其在关键指标(如 tokens-per-second)的透明度、提供商与量化方案的披露上存在不足,加深了社区的疑虑。

价值与影响

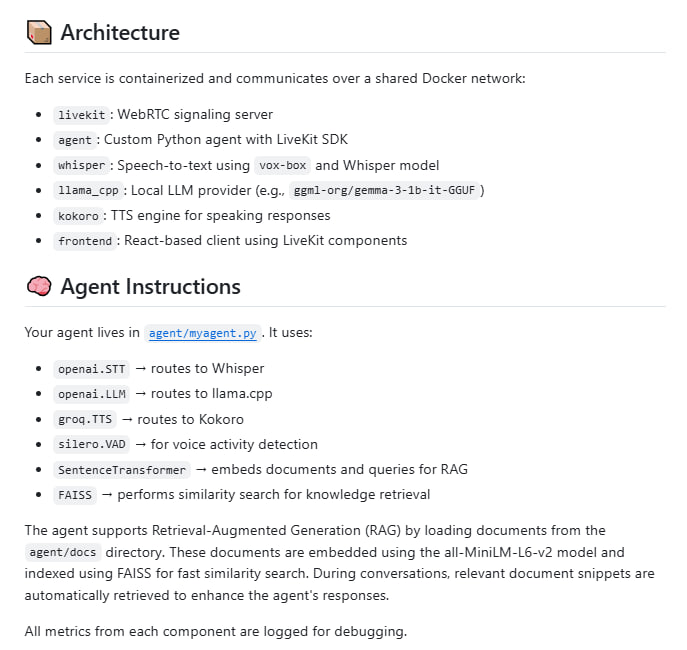

此次争议触及了“本地 AI”工具的核心价值主张:隐私、确定性与成本控制。当工具在用户不知情或无法控制的情况下建立外部网络连接并传输数据时,这些承诺便被动摇。

讨论促使社区重新审视“本地”一词的定义:模型权重能否完全离线运行?系统能否在不依赖任何外部 API 调用的情况下工作?网络访问应是可选项而非强制。依赖远程端点的运行时管道,或许更应被称为“混合”架构而非纯粹的本地工具。

作为回应,社区开始关注和转向其他更符合本地原则的替代方案,例如 Pi Coding Agent、其增强版 fork、剥离了隐私相关功能的 RolandCode,以及从头设计、原生支持智能体编程的 Nanocoder 等。这场讨论的意义已超越单个工具,关乎如何守护“本地”在 AI 开发工具领域的准确含义与信任基础。