LLM 智能体:新一代高级编程语言?

文章探讨了将 LLM 智能体视为一种新编程范式的观点,分析了其提升开发效率的潜力、面临的常见质疑,并展望了以文档、实现、对话和任务为核心的未来开发模式。

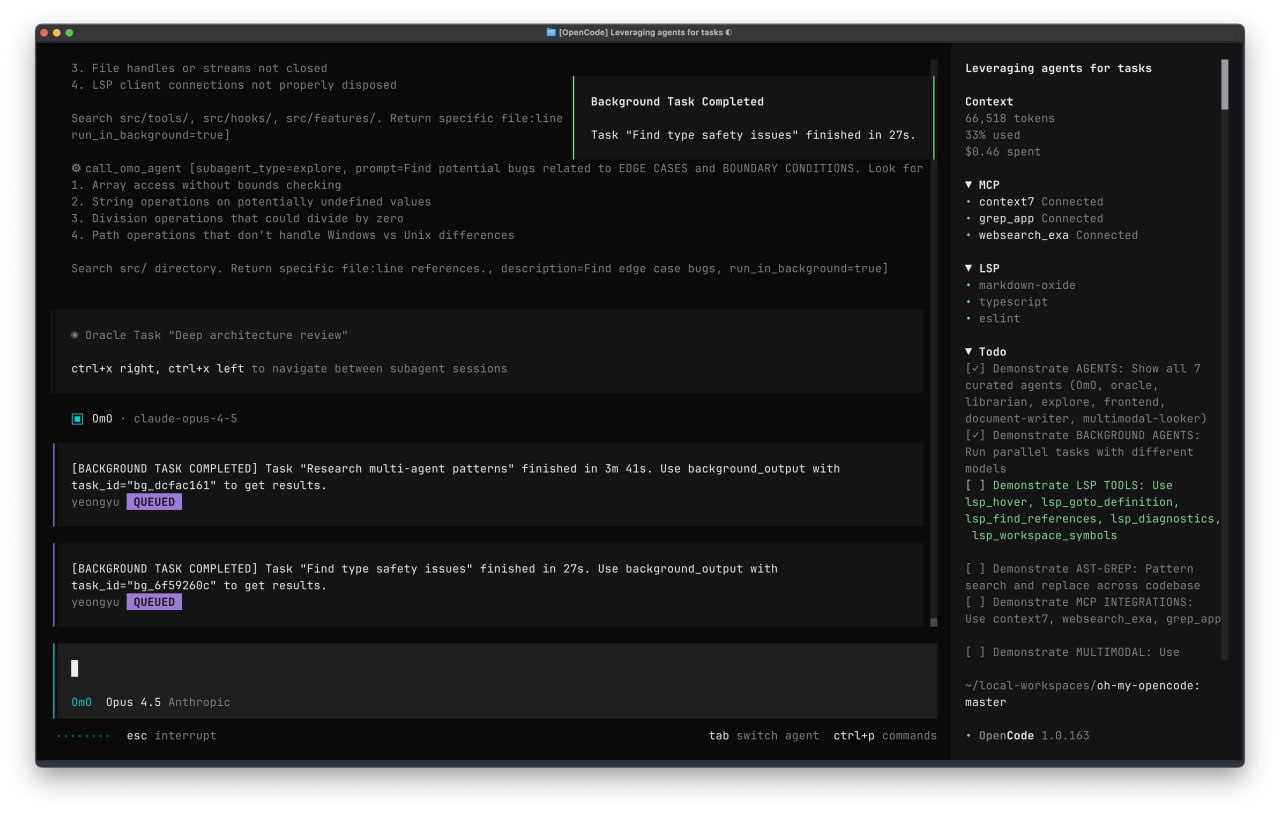

在编程语言的发展历程中,从汇编到 C,再到 Java 和 Python,每一次抽象层次的提升都显著改变了软件开发的方式。如今,一种观点认为,大型语言模型(LLM)驱动的智能体正在扮演类似的角色,可能成为新一代的“高级编程语言”。这里的 LLM 智能体指的是一种全新的开发模式:多个智能体并行工作,大部分时间自主运转,仅在关键节点需要人类介入。其核心假设在于,开发者借助多智能体协作,有望实现远超以往的产出效率。

核心内容

针对这一范式转变,业界存在诸多质疑。文章逐一进行了回应:

- 产出衡量:真正的价值在于交付的功能,而非代码行数。在这种模式下,给 LLM 的指令可能成为新的“代码”。

- 适用人群:LLM 不仅吸引新程序员,资深开发者同样能借助其实现效率飞跃。

- 工作性质:使用 LLM 管理智能体舰队,往往需要更复杂的设计与协调工作,而非减少思考。

- 技能退化:如同今天开发者无需精通汇编,未来编程技能重心可能转移,而非单纯退化。

- 代码质量:LLM 生成的代码可能不如专家手写,但只要足够高效、可用,即可交付价值。

- 成本考量:相对于可能带来的生产力提升,LLM 的成本在相对值上并不昂贵,且其价格趋势是下降的。

- 学习曲线:掌握新工具需要时间投入,这与学习传统编程语言的过程类似。

然而,更深层的挑战在于代码的质量与系统的可理解性。LLM 生成代码的长期可维护性,以及人类对庞大生成代码库的理解与控制能力,是决定这一范式能否成功的关键。文章主张,任何 LLM 编程框架都应将质量和可理解性作为核心目标。

展望未来的开发模式,文章提出了四个核心要素:

- 文档:描述系统规格,包括目的、实体、接口、约束、流程和规范。

- 实现:代码库及数据,代码应能从文档重建,数据需与文档一致。

- 对话:智能体执行任务时产生的思考流,人类可查看或介入。

- 任务:动态、离散、可嵌套且有状态追踪的工作单元。

其中,文档和实现是系统的积累(存量),对话和任务是构建过程(流量)。人类的工作重心将逐渐转向与智能体交互,智能体可扮演执行者、管理者、测试者、评审者、合并者等多种角色。

此外,模型上下文协议(MCP)被视为打破应用数据孤岛的关键。它作为一种通用数据请求接口,允许智能体从各类现有应用中提取功能和数据,实现集成与即时可视化。同时,采用良好的底层基座而非臃肿的技术栈,有助于减少 LLM 生成的代码量并提升可理解性,使系统的“前端”变为文档和智能体,“后端”变为基座。

价值与影响

将 LLM 智能体视为编程范式演进的一部分,这一视角促使开发者重新思考软件构建的本质。它强调从编写具体代码转向设计高层次指令与协调多智能体工作流。尽管在代码质量、系统可理解性、存储与版本控制等方面仍存在开放性问题,但该范式指向了一个可能性:通过提升抽象层级和自动化程度,大幅提高复杂软件系统的开发与迭代效率。其成功与否,最终将取决于能否在提升产出的同时,确保系统长期的可维护性与人类对其的掌控力。