本地AI模型能否取代云端订阅?MacBook硬件投资与开发实践分析

本文基于开发者Logan Thorneloe的实践,探讨了在MacBook上部署本地AI模型以替代云端订阅的可行性,分析了轻量化模型的性能、硬件需求、工具链挑战及投资回报,并分享了具体的技术配置方案。

随着AI模型能力的提升和硬件性能的增强,越来越多的开发者开始探索在本地设备上运行AI模型的可能性。这一趋势背后,是对云端服务订阅成本、数据隐私、响应延迟以及服务稳定性的综合考量。开发者Logan Thorneloe通过购买顶配MacBook并进行数周的真实开发测试,旨在验证一个核心假设:本地AI模型能否有效替代每月超过100美元的云端AI服务订阅。

核心内容

测试结果表明,当前的轻量化模型表现远超预期。即便是仅有7B参数的模型,其能力也足以处理超过90%的日常开发任务。这意味着,对于大多数编码场景,开发者并不需要依赖庞大的云端模型。在硬件需求方面,实际运行并不一定需要顶配的128GB内存设备,配备32GB或64GB内存的MacBook已经能够流畅运行性能出色的模型。

本地化部署的价值不仅在于潜在的成本节约,更在于对计算资源的完全掌控。这带来了更严密的隐私保护、近乎零延迟的稳定性,以及不会因服务商策略调整而导致的性能随机降级。本地模型没有服务宕机风险,可以视为一种专属的、持续可用的数字生产力工具。

然而,实践过程中也揭示了主要的挑战所在。真正的瓶颈往往不在于模型本身,而在于工具链的集成。将本地模型无缝、可靠地接入现有的开发工作流(如IDE)需要付出相当的调试与配置成本。此外,本地模型在运行时的高性能需求会直接导致设备风扇噪音增大和电池续航时间显著缩短,这是追求本地算力必须接受的代价。

关于硬件投资的经济性,分析给出了一个清晰的判断框架:如果开发者每月在诸如Cursor或Claude等云端服务的支出超过100美元,那么投资高性能硬件是明智的,因为模型正朝着更小、更强的趋势发展。反之,如果替代方案是依赖谷歌等厂商提供的免费额度,那么昂贵的硬件投资在短期内很难收回成本。

基于以上分析,一种可行的混合策略是:将本地模型作为主力,处理绝大部分常规编码任务;同时将免费的云端大模型作为补充,用于应对剩余10%左右需要极致性能或复杂推理的特殊场景。

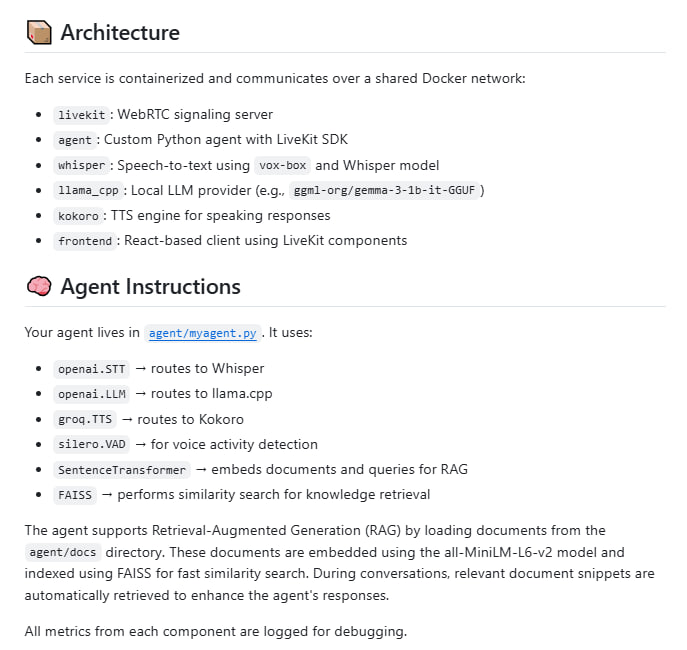

在技术实现层面,作者的具体配置方案是:选用Qwen3系列模型,通过苹果的MLX框架进行部署和优化,并配合Qwen Code CLI作为核心的开发工具链组成部分。

价值与影响

这项实践的意义超越了单纯的技术选型。它代表了算力本地化的一种趋势,即开发者正尝试从持续性的云端订阅模式中挣脱,回归对自身数字工作流的直接控制权,这可以被视为一种“数字主权”的回归。当模型效率持续提升、消费级硬件性能不断增强,在个人设备上运行高性能AI模型正从概念走向实用。这不仅为开发者提供了成本控制的另一种思路,也促使整个生态更加关注本地化部署的工具链成熟度与用户体验。未来,如何在性能、成本、便利性与隐私之间取得最佳平衡,将是开发者持续探索的方向。

来源:黑洞资源笔记