Meta REFRAG:通过压缩与强化学习优化RAG

Meta推出的REFRAG技术,通过在嵌入层面对文本块进行压缩,并利用强化学习策略进行相关性筛选,显著减少了送入大语言模型的无关token数量。该方法在提升响应速度、支持更大上下文窗口的同时,保持了模型准确性。

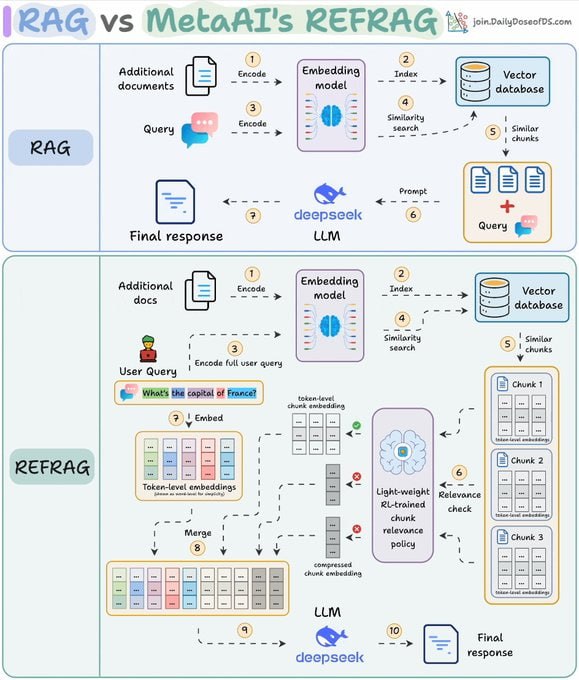

检索增强生成(RAG)系统通过结合外部知识库来增强大语言模型(LLM)的生成能力,已成为解决模型知识局限性的主流方案。然而,传统 RAG 系统在检索阶段往往会返回大量文本块,导致 LLM 需要处理成千上万的无关 token。这不仅造成了高昂的计算成本,也严重影响了系统的响应速度和效率,形成了所谓的“token膨胀”问题。

核心内容

Meta 提出的 REFRAG 技术,旨在从嵌入(embedding)层面解决上述痛点。其核心创新在于“压缩-筛选-展开”的工作流程。首先,在文档编码阶段,每个文本块被压缩成一个单一的嵌入向量并存入向量数据库。当进行查询时,系统会检索出相关的嵌入块,然后通过一个强化学习策略对这些嵌入进行相关性评分和筛选。只有被判定为最相关的少数嵌入块会被“展开”为完整的 token 向量,而其他相关度较低的块则保持压缩状态或被直接过滤。最终,所有经过处理的信息(包括展开的 token 和压缩的嵌入)被一并输入给 LLM 进行处理。

这种方法带来了显著的性能提升。根据相关测试结果,REFRAG 使得首个 token 的响应速度提升了 30 倍以上,能够支持 16 倍于以往的上下文窗口,同时将需要处理的 token 数量减少了 2 到 4 倍。在 16 个 RAG 基准测试中,其表现超越了 LLaMA。

价值与影响

REFRAG 的价值在于,它没有牺牲 RAG 系统的准确性,而是通过智能筛选机制,精准地提炼出对当前查询最重要的信息,从而优雅地解决了“token膨胀”带来的隐藏成本。这一突破展示了将向量空间操作与强化学习策略相结合,在大模型优化领域的巨大潜力。它预示着未来的检索系统将更加依赖此类智能、动态的筛选策略,而非简单地增加检索数量或扩大上下文窗口。REFRAG 为提升大模型应用效率提供了一个新思路:真正的效率提升,源于对信息的精准提炼,而非资源的无限堆叠。