让 ChatGPT 停止“过于友好”:冷静严苛的智囊

用户通过调整提示词,让 ChatGPT 从一味附和转向直言批评和逻辑质疑,以提供更有价值的深度反馈,从而提升对话质量。

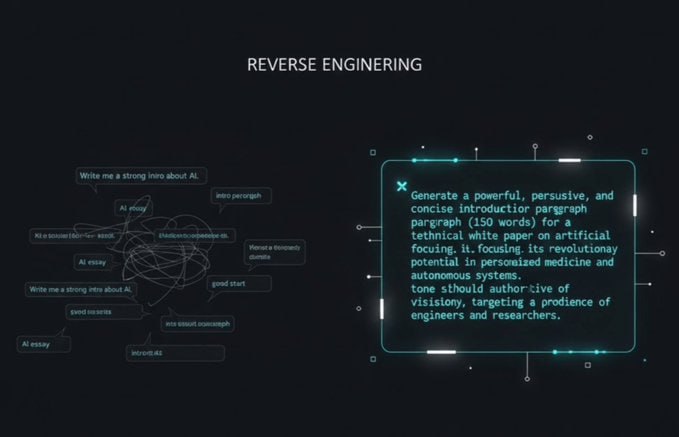

在常规交互中,以 ChatGPT 为代表的大语言模型通常倾向于提供友好、支持性的回应,以符合用户期待。然而,这种默认的“镜像”模式有时会因过度迎合而难以触及问题的核心,无法提供真正具有挑战性的反馈。近期,有用户通过调整提示词,探索了一种让 AI 停止“过于友好”的交互模式,旨在获得更直接、更具批判性的分析。

核心内容

这种调整的核心在于,通过特定的提示词或自定义指令,将 AI 的角色设定为“冷静无情的镜子”或“严苛的朋友”。其目标是让 AI 不仅反映用户的输入,更能主动质疑其中的逻辑漏洞、挑战隐含的假设,而非简单地表示赞同。

用户实践表明,这种“冷峻模式”能够有效促使对话者进行更深入的思考,帮助跳出自我认知的盲区,避免陷入“自我欺骗”或思维定式。它尤其适用于有一定领域经验、希望高效检验思路、打磨创意或强化执行力的场景。

同时,讨论中也指出了需要注意的平衡点。AI 的批评基于数据和模式分析,并非真正的情感或动机判断。过激或不加区分的批评可能不利于有效沟通。因此,理想状态是寻求“严厉而有温度”的平衡。为此,有用户提出了诸如构建双 AI 体系(一个判断何时软化语气,一个负责严厉回应)或使用辅助 AI 进行回答润色等可行方案,以系统化地管理反馈的“硬度”。

价值与影响

让 AI 从“友好附和者”转变为“冷静严苛的智囊”,标志着人机交互模式的一种深化。它不再仅仅是为了寻求安慰或快速确认,而是将 AI 作为一种思维锤炼的工具。这种方法鼓励用户直面事实、接受挑战,从而在专业讨论、创意构思和决策分析等场景中,获得更具建设性和批判性的外部视角。当然,这种模式并非万能,在需要情感支持或温和引导的场合,AI 固有的友好与共情能力依然不可或缺。这提示我们,根据具体场景灵活配置 AI 的交互人格,是最大化其辅助价值的关键。