从零构建 MiniLLM:预训练与指令微调实践

本文介绍一个旨在以可控成本构建小参数量聊天模型的 GitHub 项目。该项目已完成预训练和指令微调阶段,使用 bert4torch 框架,优化了内存占用,并支持与 Transformers 无缝衔接推理。

在大型语言模型(LLM)研发领域,高昂的计算成本常常成为研究和实践的门槛。为了探索在有限资源下构建可用聊天模型的路径,一个名为“从0到1构建一个MiniLLM”的 GitHub 项目应运而生。该项目旨在通过系统化的流程,以可控的成本完成一个小参数量的语言模型构建。

核心内容

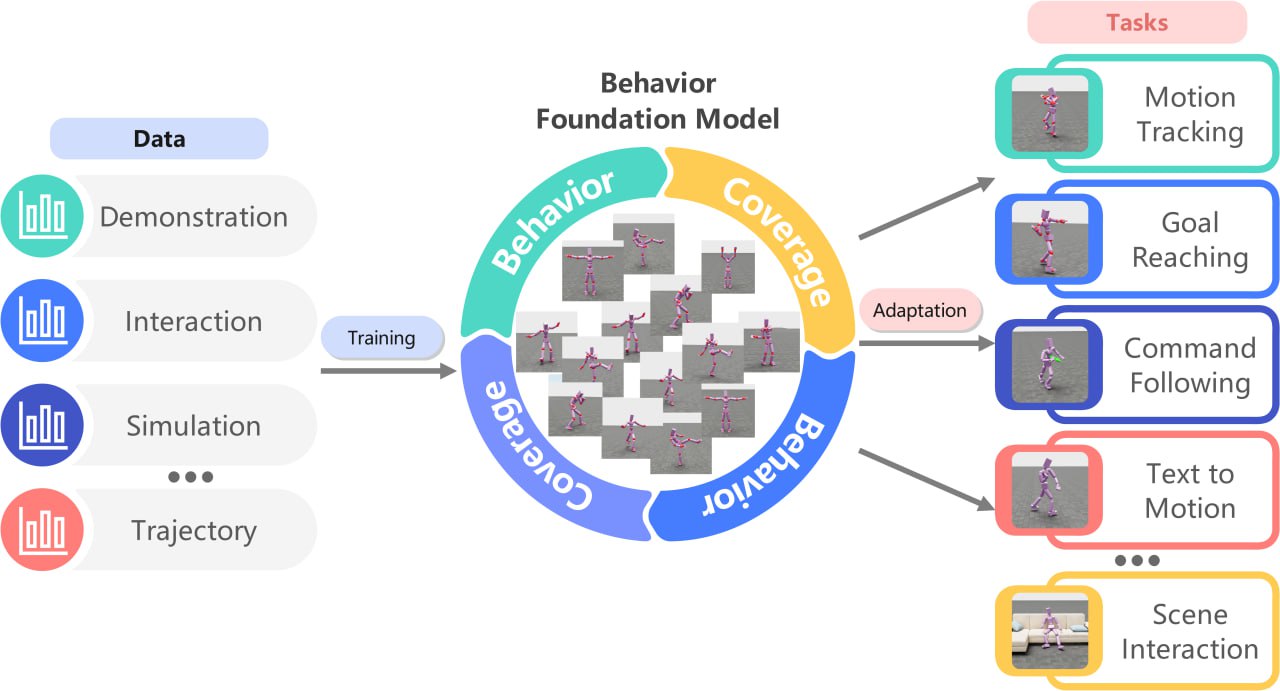

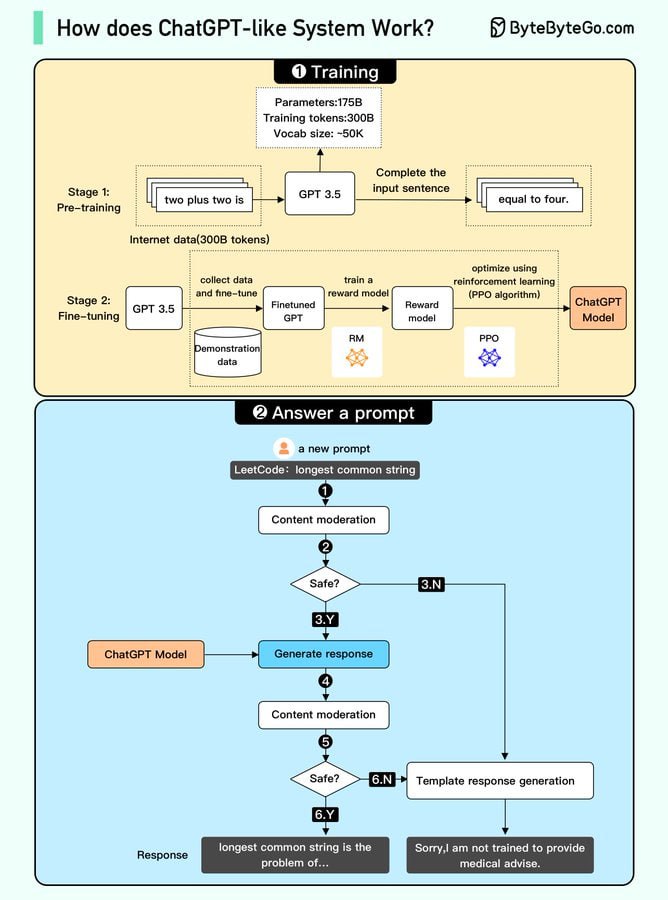

该项目的核心目标是走完构建聊天模型的四个关键阶段:预训练、指令微调、奖励模型训练以及强化学习。目前,项目已完成了前两个阶段,即预训练和指令微调,成功产出了一个具备基础对话能力的模型。

在技术实现上,项目选用了 bert4torch 作为训练框架,其代码设计以简洁高效见长。一个显著的优势在于,训练所得的模型检查点(checkpoint)能够无缝衔接至业界广泛使用的 Transformers 库,用户可以直接使用 Transformers 进行模型推理,这极大地提升了模型的实用性和易用性。

为了优化训练过程的资源消耗,项目对训练时的文件读取方式进行了专门优化,有效降低了内存占用。同时,项目提供了完整的训练日志,为其他研究者进行复现和效果比对提供了可靠依据。在模型能力方面,项目引入了自我认知数据集,允许开发者自定义机器人的名称、作者等属性,并且最终产出的聊天模型支持多轮对话交互。

价值与影响

该项目为资源受限的研究者、学生或开发者提供了一个清晰的实践范例,展示了如何通过分阶段、有重点的开发流程,以较低成本构建出具备基本功能的语言模型。其与 Transformers 生态的无缝集成降低了模型部署和应用的门槛。优化后的训练流程和公开的完整日志,也为社区在小型模型训练效率与可复现性方面的讨论提供了具体案例。尽管项目尚未完成奖励模型与强化学习阶段,但其当前成果已为理解 LLM 构建的前期关键步骤提供了有价值的参考。