Meta 超大规模 AI 基础设施设计解析

本文基于 Meta 2024 年公开文章,介绍其两个大规模 AI 集群的设计,每个集群包含 2.4 万张 H100 GPU,并涵盖网络、存储等关键基础设施细节。

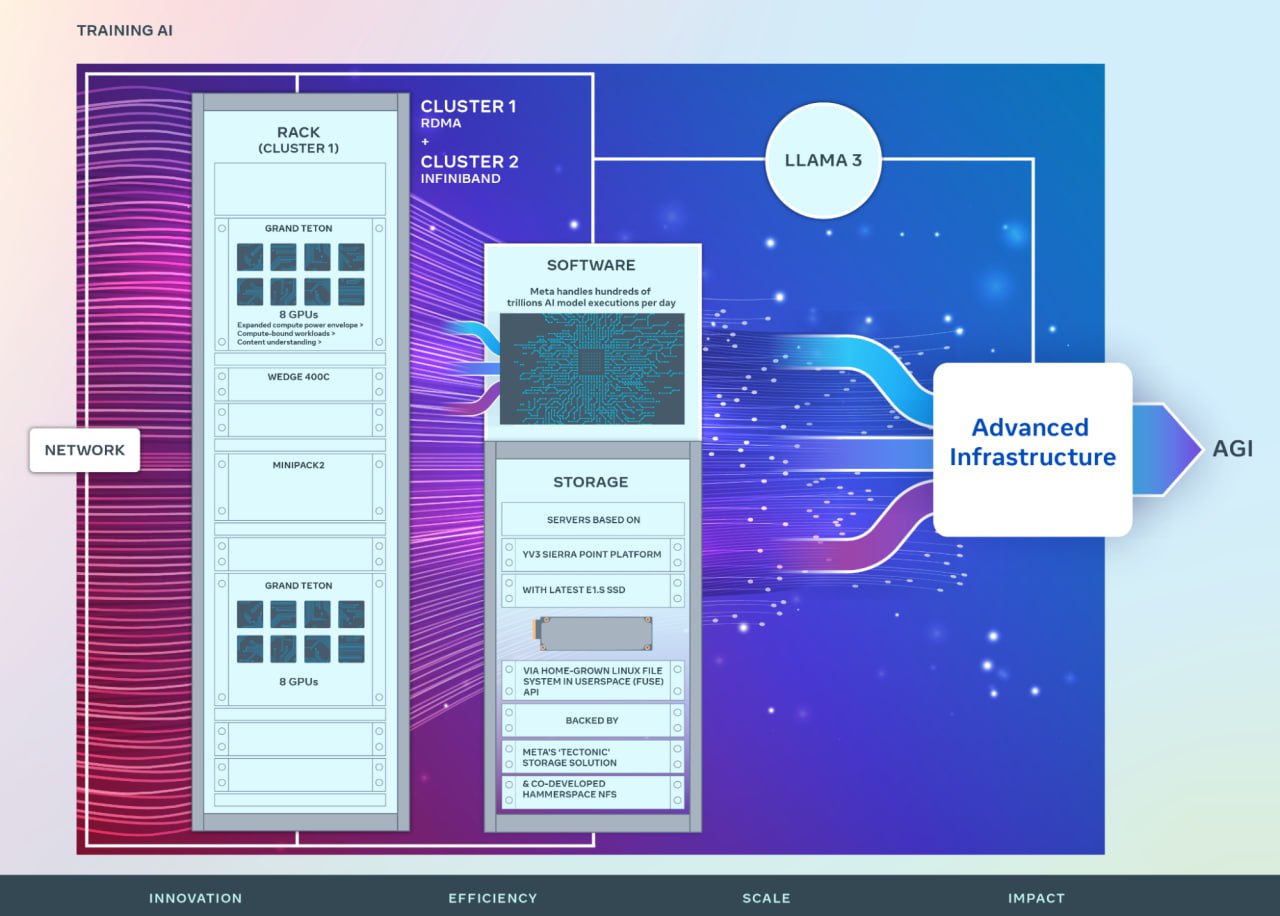

随着生成式 AI 模型的规模与复杂性急剧增长,支撑其训练与推理的底层基础设施变得至关重要。作为对这一趋势的重要回应,Meta 在 2024 年公开分享了其构建超大规模 AI 基础设施的实践经验。这些基础设施不仅是技术投资的体现,更是推动如 LLaMA 3 等前沿模型研发的基石。

核心内容

Meta 设计并部署了两个大规模 AI 集群,其核心架构围绕高性能计算与高速互联展开。每个集群集成了 24,000 张 NVIDIA H100 GPU,以提供强大的并行计算能力。在网络设计上,Meta 采取了异构策略,两个集群分别采用了 RoCE (RDMA over Converged Ethernet) 和 InfiniBand 两种主流的高性能网络技术,旨在优化大规模 GPU 间的通信效率与可靠性。

除了计算与网络,存储系统的设计也针对 AI 工作负载的数据密集型特点进行了优化,以确保训练数据能够被高效访问。整个基础设施的设计目标是在保证高可用性和可扩展性的同时,最大化集群的整体计算吞吐量。

价值与影响

这一基础设施已直接应用于 Meta 的重要 AI 研发项目。据悉,最新的 LLaMA 3 大语言模型便是在这两个集群上完成训练的,验证了其设计的有效性与强大算力。根据规划,到 2024 年底,Meta 的 AI 基础设施总规模预计将扩展至拥有相当于约 60 万张 H100 GPU 的算力。这一举措不仅巩固了 Meta 在 AI 领域的基础能力,也为行业构建超大规模 AI 计算集群提供了重要的参考范本,推动了高性能计算与网络技术在 AI 场景下的进一步融合与发展。

来源:黑洞资源笔记