Gemma 3:谷歌新一代多功能AI模型发布

TechFoco 精选

谷歌发布Gemma 3模型,支持图像与文本的多模态输入,上下文窗口达128k tokens,覆盖140多种语言,并提供1B至27B四种参数规模选择。

谷歌近期正式发布了其新一代开源AI模型系列 Gemma 3。该系列旨在为开发者和研究人员提供一个功能强大且灵活的基础模型,以支持更广泛的多模态交互与高效应用开发。

核心内容

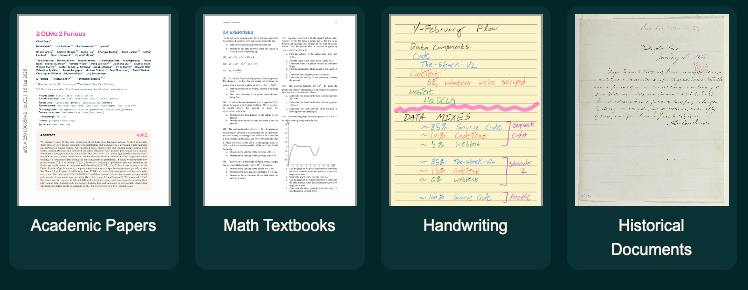

Gemma 3 的核心特性主要体现在三个方面。首先,它支持多模态输入,能够同时处理图像和文本信息,这为构建理解视觉与语言内容的应用程序奠定了基础。其次,模型具备高达 128k tokens 的上下文窗口,能够处理更长的对话或文档,增强了其在复杂任务中的连贯性与信息保持能力。此外,该模型支持超过 140 种语言,显著提升了其全球适用性。

为了满足不同场景下的计算资源与性能需求,Gemma 3 提供了四种不同参数规模的版本,分别是 1B、4B、12B 和 27B。这种梯度化的设计允许用户根据自身需求在模型能力与部署成本之间进行权衡。

价值与影响

Gemma 3 的发布为 AI 社区提供了一个新的、功能全面的开源选择。其多模态能力和大上下文窗口特性,有望推动在文档分析、多语言助手和跨模态内容理解等领域的研究与应用创新。同时,多样化的模型规模也为从边缘设备到云端服务器的不同部署环境提供了可能性,有助于降低 AI 技术的应用门槛并加速实际落地。